KI-Feedback: Von KI generiertes Feedback verbessert die Mitarbeiterleistung stärker als menschliches Feedback, sofern die Herkunft verschwiegen bleibt.

Offenlegungseffekt: Die Offenlegung der KI als Feedbackquelle führt zu Widerstand und verschlechtert die Leistung aufgrund von Vertrauensproblemen.

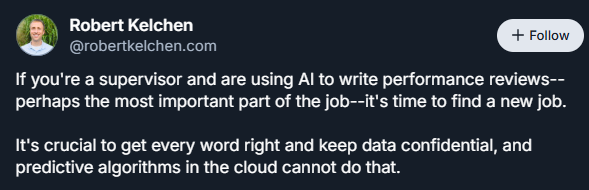

Vertrauenskritik: Das Vertrauen der Beschäftigten in den KI-Einsatz der Unternehmen ist gering; viele sehen dadurch eine Zunahme von Vorurteilen.

Transparenzstrategie: Eine offene Kommunikation über den KI-Einsatz im Feedbackprozess empfiehlt sich, um langfristige Vertrauensschäden zu vermeiden.

Langzeitwirkung: Die Entscheidung zwischen Transparenz und Intransparenz offenbart die Werte der Organisation und beeinflusst deren Widerstandsfähigkeit.

Die besten Leistungsfeedback-Systeme funktionieren in gewisser Weise wie ein Zaubertrick: Sie sind am effektivsten, wenn man nicht weiß, wie der Trick gemacht wird.

Eine im Strategic Management Journal veröffentlichte Studie aus dem Jahr 2021 zeigte, dass KI-generiertes Feedback die Mitarbeiterleistung stärker verbessert als Feedback von menschlichen Führungskräften. Der Haken? Es funktionierte nur, wenn die Mitarbeiter glaubten, ein Mensch habe das Feedback verfasst. Wird die Methode enthüllt, verschwindet die Magie.

Das Feedback war konsistenter, personalisierter und objektiv effektiver darin, die Leistung zu steigern. Aber sobald die Beschäftigten erfuhren, dass Algorithmen ihre Leistungseinblicke generiert haben, verpufften die positiven Effekte.

Das gleiche Feedback, das zu besseren Ergebnissen führte, wenn es einem menschlichen Vorgesetzten zugeschrieben wurde, rief Widerstand, geringere Beteiligung und schlechtere Leistungen hervor, sobald die Mitarbeiter die wahre Quelle kannten. Die Forscher nannten dies den „Offenlegungseffekt“ – einen messbaren Leistungsabfall, der allein dadurch entsteht, dass bekannt ist, dass KI im Spiel ist.

KI im Leistungsmanagement ist heutzutage immer häufiger anzutreffen, genauso wie KI in anderen Lebensbereichen mit der weiten Verbreitung von Tools wie ChatGPT, Claude und Gemini genutzt wird. Doch der bloße Anstieg im Einsatz bedeutet nicht, dass damit auch das Vertrauen gestiegen ist.

Für HR-Führungskräfte, die mit der Einführung von KI umgehen müssen, ergibt sich aus dem im Jahr 2021 entdeckten Paradoxon eine unmögliche Lage: Setzt man KI-basierte Feedback-Systeme offen ein, opfert man die Leistungssteigerungen. Versteckt man den KI-Einsatz hingegen, riskiert man massiven Vertrauensverlust, wenn die Wahrheit unweigerlich ans Licht kommt.

Diese Entscheidung enthüllt Grundlegendes darüber, worauf Organisationen optimieren: Geht es um die Zahlen dieses Quartals oder die langfristige Transformationsfähigkeit?

Der Kontext der Vertrauenskrise

Der Offenlegungseffekt geschieht nicht im luftleeren Raum. Aktuelle Forschungen von SHL zeigen, dass nur 27 % der Beschäftigten ihren Arbeitgebern voll vertrauen, KI in HR-Entscheidungen verantwortungsvoll einzusetzen. Noch alarmierender: 59 % glauben, dass KI die Voreingenommenheit am Arbeitsplatz eher verschlimmert als verbessert.

Das rückt das Paradoxon noch stärker in den Fokus. Die Technologie, die objektiv gesehen besseres und weniger voreingenommenes Feedback liefern kann, wird genau von den Beschäftigten, die davon profitieren könnten, misstraut. Und die Forschung legt nahe, dass dieses Misstrauen sich selbst bestätigt: Zu wissen, dass KI involviert ist, führt zu schlechteren Leistungen – egal, ob das Feedback an sich tatsächlich besser ist.

Dr. Ryne Sherman, Chief Science Officer bei Hogan Assessments, einem Unternehmen, das mit über 75 % der Fortune-500-Unternehmen zusammenarbeitet, sieht zwei Kräfte, die den Widerstand der Beschäftigten antreiben.

Der erste Punkt ist die Annahme, dass KI die Nuancen des Arbeitsplatzes nicht erfassen kann. Wir nehmen an, dass ein menschlicher Bewerter von Leistung das organisatorische Umfeld besser versteht und Leistungen eher wertschätzt, die nicht erfasst werden können durch Dinge, die ein Computer leicht zählen kann.

Der zweite Faktor sitzt noch tiefer. Es geht weniger darum, ob KI Leistungen korrekt bewerten kann, sondern darum, was die Entscheidung für KI über die Sichtweise einer Organisation auf ihre Mitarbeitenden aussagt.

„Das Fehlen menschlichen Inputs gibt den Mitarbeitenden das Gefühl, sie würden schlicht als Ressource abgewickelt, ohne Empathie oder Interesse an ihrem Wohlergehen als Menschen“, sagt Sherman. „Unsere Forschung zeigt, dass die wirksamsten Führungskräfte echtes Interesse an ihren Mitarbeitenden zeigen. Den Einsatz von KI für Leistungsbeurteilungen interpretieren Beschäftigte als Desinteresse der Führungskräfte an ihren Mitarbeitern.“

Ob diese Annahmen zutreffen, ist weniger entscheidend, als die Tatsache, dass sie existieren. Die Wahrnehmung der Mitarbeitenden prägt das Verhalten – und das Verhalten prägt die Leistung.

Warum Täuschung nicht funktioniert

Unternehmen, die die Leistungssteigerungen durch KI nutzen wollen, aber den Offenlegungseffekt umgehen möchten, stehen vor einem praktischen Problem: Die Mitarbeitenden wissen es bereits.

Edie Goldberg, Arbeits- und Organisationspsychologin und Autorin des demnächst erscheinenden Buchs Performance Enablement, verweist auf die verräterischen Anzeichen, an denen man KI-generiertes Feedback erkennt.

Die meisten Mitarbeitenden können erkennen, wenn Feedback von einem Computer mit all diesen Gedankenstrichen verfasst wurde. Diese Art von Rückmeldung mangelt oft an der Spezifität, die ein Vorgesetzter bieten könnte.

Die stilistischen Muster von KI-generierten Texten sind mittlerweile so erkennbar, dass es zwecklos erscheint, deren Einsatz verbergen zu wollen. Selbst wenn Organisationen den KI-Einsatz nicht explizit ausweisen, erkennen Mitarbeitende die algorithmischen Fingerabdrücke.

Das untergräbt die gesamte Strategie des Verbergens. Wenn Mitarbeitende einen KI-Einsatz vermuten, aber nicht direkt informiert werden, entsteht die schlechteste Konstellation: ein Leistungsabfall durch den wahrgenommenen KI-Einsatz kombiniert mit dem Vertrauensverlust aufgrund des Täuschungsversuchs.

Goldbergs empfohlene Herangehensweise umgeht dieses Paradoxon vollständig.

Die Unterscheidung ist entscheidend. KI kann Rückmeldungen aus verschiedenen Perspektiven integrieren – von Kolleg:innen, Kund:innen, internen Kommunikationsplattformen – und diese mit harten Daten aus internen Systemen kombinieren.

„All diese Faktoren machen das Feedback von Natur aus gerechter, weil es eben nicht nur die Sichtweise einer einzelnen Person ist“, sagt Goldberg mit Verweis auf die umfangreiche Forschung zu Voreingenommenheit von Führungskräften bei Leistungsbeurteilungen.

Doch diesen Fairness-Vorteil gibt es nur, wenn Mitarbeitende dem Prozess vertrauen. Goldberg betrachtet dies eher als ein Problem der Arbeitsteilung denn der Transparenz: KI einsetzen, wenn es ums Aggregieren und Erkennen von Mustern geht – darin ist sie stark. Den Menschen weiterhin die Verantwortung für Kontext, Spezifität und Beziehungsaspekte überlassen, damit Rückmeldungen als authentisch empfunden werden.

Letztlich besteht die Lösung nicht darin, die Rolle der KI zu verbergen, sondern sie neu zu definieren.

Die Transparenz-voran-Position

Kate O'Neil, CEO der Performance-Management-Plattform Opre, hat ihr gesamtes Produkt um die Ablehnung des Verschleierungsansatzes herum aufgebaut. Sämtliches Feedback, das Opre-Nutzer:innen erhalten, ist eindeutig als KI-generiert gekennzeichnet, und weder Führungskräfte noch Mitarbeitende können es manipulieren, um menschlich verfasst zu wirken.

Es sollte niemals Verwirrung darüber geben, was von KI generiert wurde und was von Menschen stammt. Schließlich: Wie sollen wir einen Menschen in den Prozess einbinden, wenn niemand weiß, was menschlich und was KI-gesteuert ist? Unklarheit darüber, wer das Feedback erstellt hat, verwässert letztlich nur die Führungsverantwortung.

Die Designphilosophie von Opre zielt auf das ab, was O'Neil als „Manager-und-Mitarbeitende-vs.-Opre“-Dynamik bezeichnet. Das System schickt Leistungseinblicke an beide Parteien gleichzeitig und schafft so eine gemeinsame Grundlage für das Gespräch – statt einer Top-Down-Bewertung.

Im nächsten Einzelgespräch diskutieren Führungskraft und Mitarbeitende dann, was Opre richtig erkannt hat, was nicht und welchen Kontext das System eventuell falsch einschätzt.

„Das ersetzt die deutlich weniger produktive Dynamik, die wir heute oft sehen: Führungskraft gegen Mitarbeitende – besonders, wenn die Leistung schlecht ist oder Leistungsgespräche vermieden werden“, erklärt O'Neil.

O'Neil räumt allerdings ein, dass sie keine Vergleichsdaten hat. „Ich weiß nicht, ob es etwas bewirkt, wenn Mitarbeitende wissen, dass das Feedback von KI stammt – mir fehlt eine Vergleichsgruppe, die es nicht wusste.“

Gefragt, ob durch die Priorisierung von Transparenz Performance-Vorteile verschenkt werden, bleibt O'Neil klar.

Ich glaube nicht, dass die Kenntnis über den KI-Ursprung die Wirksamkeit zerstört. Die Illusion von Echtheit, wenn sie nicht vorliegt, zerstört das Vertrauen und die sozialen Beziehungen zwischen Führungskräften und Teams. Zerstörtes Vertrauen ruiniert Leistung.

Sie geht bei der Frage nach Vorurteilen noch weiter. Selbst wenn KI-generiertes Feedback kurzfristig objektiv Vorurteile reduziert, schafft das Verbergen seiner Herkunft ein Vertrauensproblem, das letztlich im Laufe der Zeit die Voreingenommenheit verstärkt.

„Wenn KI-generierte Inhalte tatsächlich Vorurteile abbauen, die Mitarbeitenden aber wahrnehmen, dass sie zunehmen, hat das langfristig zur Folge, dass das Vertrauen geschwächt wird“, erklärt O'Neil. „Führungskräfte, die KI-Feedback als ihr eigenes ausgeben, schwächen das Vertrauensverhältnis zu ihren Teams – und das führt später zu einer Zunahme von Voreingenommenheit.“

Deshalb verhindert Opres System, dass Führungskräfte KI-generierte Erkenntnisse nachträglich bearbeiten oder abschwächen. Beide, Führungskraft und Mitarbeitende, erhalten gleichzeitig identisches Feedback, wodurch Täuschungen ausgeschlossen werden. Führungskräfte und Mitarbeitende können Kontext ergänzen oder beim System um Erläuterungen bitten – aber sie dürfen das Ergebnis nicht verändern.

Ihre Haltung beruht auch auf einer Einschätzung der Zeithorizonte. Organisationen können entweder für sofortige Leistungskennzahlen optimieren oder für die Fähigkeit, sich über Jahre hinweg zu transformieren. Beide Ziele sind aus ihrer Sicht bei der Einführung von KI unvereinbar.

„Intransparenz ist keine Leistungsstrategie“, sagt sie. „Sie ist eine kurzfristige Ausschöpfungsstrategie. Man bekommt vielleicht kurzfristig eine Leistungsspitze, wenn Mitarbeitende versuchen, die Regeln zu durchschauen. Doch danach verliert man die besten Leute, erschöpft den Rest und beschädigt die Fähigkeit, neue Talente zu gewinnen.“

Wenn Vertrauen zerbricht

Sowohl Goldberg als auch Sherman warnen, dass Täuschungen rund um den Einsatz von KI Folgen haben, die jedes kurzfristige Leistungsplus bei weitem übertreffen.

„Es ist leicht, Vertrauen zu zerstören, und sehr schwer, es wieder aufzubauen“, sagt Goldberg. „Es gibt hier keinen Vorteil, nur Risiken.“

Diese Warnung ist kein ethischer Appell. Sowohl Goldberg als auch Sherman arbeiten in Umfeldern, in denen sie die Folgen von Vertrauensverlust quer durch verschiedene Organisationen erleben. Ihre Überzeugung, dass Täuschung scheitert, basiert auf Mustererkennung, nicht auf Philosophie.

„Es ist verheerend für Organisationen, auf betrügerische Praktiken bei Leistungsbeurteilungen zu setzen“, warnt Sherman. „Erstens gibt es in keiner Organisation irgendeiner Größe eine Chance, dass eine solche Täuschung nicht herauskommt. In jedem Unternehmen gibt es Informationslecks – und solche Informationen dringen immer nach außen.“

Die Folgen, so Shermans Einschätzung, wären gravierend.

„Sobald diese Information bekannt wird, sinkt das Vertrauen in die Organisation auf den absoluten Tiefpunkt“, sagt er. „Die Mitarbeitenden werden protestieren, kündigen und vielleicht noch schlimmer: völlig desinteressiert sein.“

Sein Rezept für Organisationen, die in eine solche Lage geraten, ist deutlich. Mitarbeitende werden Verantwortlichkeit fordern, was vermutlich die Entfernung von Führungskräften einschließt, die an der Täuschung beteiligt waren.

„Selbst dann“, so sagt er, „wird die Organisation ernsthaft in Erwägung ziehen müssen, den gesamten Prozess der Leistungsbeurteilung radikal transparent zu gestalten, um Vertrauen überhaupt wiederherzustellen.“

Goldbergs Rat für Organisationen in einer solchen Situation ist einfacher, führt aber zum gleichen Schluss.

Was die Entscheidung offenbart

Die Entscheidung, ob der KI-Einsatz im Performance Management offengelegt wird, wird selten als Wahl zwischen Leistung und Vertrauen dargestellt. Meistens ist es eine Frage der technischen Umsetzung oder eine Change-Management-Herausforderung. Doch die Forschung legt nahe, dass es in Wahrheit ein Lackmustest für Organisationswerte ist.

Unternehmen, die auf kurzfristige Leistungskennzahlen optimieren, haben ein deutliches Interesse daran, den KI-Einsatz zu verbergen. Der Einführungseffekt ist real und messbar.

Unternehmen, die auf langfristige Transformation setzen, können sich einen Vertrauensbruch nicht leisten – selbst wenn das bedeutet, kurzfristig geringere Leistung hinzunehmen.

Es gibt zudem eine problematische soziale Dimension, die Praktiker selten explizit ansprechen. In Organisationen, die den KI-Einsatz nur teilweise offenlegen: Wer wird informiert? Bekommen Führungskräfte transparente KI-Systeme, während Beschäftigte an der Basis versteckte KI-Rückmeldungen erhalten? Die Vertrauenslücke zwischen Management und Mitarbeitenden ist bereits groß. Selektive Offenlegung könnte sie vollends sprengen.

Shermans Hinweis auf die Unvermeidbarkeit der Entdeckung ist besonders wichtig. In Zeiten, in denen Mitarbeitende interne Kommunikation abfotografieren, anonym auf Bewertungsportalen posten und sich über private Slack-Kanäle organisieren, ist es unrealistisch anzunehmen, dass der KI-Einsatz bei Leistungsbeurteilungen geheim bleibt.

Kommt hinzu, dass – wie Goldberg feststellt – Mitarbeitende KI-generierte Texte inzwischen schon an ihren Mustern erkennen. Die Versteck-Strategie wirkt daher mehr wie Hinauszögern als wie eine echte Strategie.

Die Frage ist damit nicht, ob Mitarbeitende es herausfinden, sondern, was geschieht, wenn es passiert.

AI Transparency in Performance Management

Eine andere Anwendung

Goldberg sieht das eigentliche Potenzial von KI im Leistungsmanagement aus einer ganz anderen Richtung kommen: Echtzeit-Feedback anstelle von jährlichen oder vierteljährlichen Bewertungen.

„KI-Systeme können sehr viel Feedback im Moment liefern, wenn es am nützlichsten ist“, erklärt sie. „Aber KI kann all diese Feedbackpunkte über einen Leistungszeitraum hinweg integrieren und so ein ausgewogeneres und weniger voreingenommenes Bild individueller Leistung bieten. Das ist die Stärke von KI im Leistungsmanagement – nicht einfach, die Bewertung zu verfassen.“

Dadurch erhält die Frage der Offenlegung eine neue Perspektive. Wenn KI unmittelbares, kontextbezogenes Feedback zu konkreten Handlungen gibt – beispielsweise wenn Projektzeitpläne ins Stocken geraten, Änderungen bei Kooperationsmustern auffallen, oder die Kommunikation seltener wird – ist die Quelle weniger entscheidend als die Schnelligkeit. Mitarbeitende sehen den direkten Zusammenhang zwischen ihren Handlungen und dem Feedback – das schafft Vertrauen in die Genauigkeit des Systems, statt es zu untergraben.

Die von KI verfasste jährliche Leistungsbeurteilung löst den Offenlegungseffekt weiterhin aus, weil hier menschliches Urteil nachgeahmt wird – in einem Kontext, in dem Beziehungen und Autorität eine Rolle spielen.

Echtzeit-Feedback von KI funktioniert in einem anderen Modus. Es gibt nicht vor, menschliche Weisheit zu sein, sondern liefert datengestützte Beobachtungen, die Menschen in dieser Größenordnung nur schwer leisten könnten.

Ob dieser Ansatz tatsächlich den Leistungsabfall vermeidet, den die Offenlegung verursacht, ist in großem Maßstab nach wie vor nicht belegt – zumindest soweit ich recherchieren konnte. Die Wahrnehmung dieser Frage mag sich auch verändern, je weiter die Vertrautheit mit KI wächst. Es deutet jedoch darauf hin, dass die Debatte um Verbergen oder Offenlegen möglicherweise die falsche Frage zur falschen Anwendung der Technologie stellt.

Die ungelöste Frage

Für Führungskräfte, die heute über den Einsatz von KI entscheiden, bieten die Forschungsergebnisse keine bequemen Lösungen.

Transparenzbefürworter wie O'Neil, Goldberg und Sherman argumentieren, dass das Verbergen von KI-Einsatz beim Bekanntwerden zwangsläufig eine Katastrophe für das Vertrauen auslöst – zumal Mitarbeitende KI-generierte Texte ohnehin schon erkennen können. Es ist besser, KI-bereite Unternehmenskulturen durch Ehrlichkeit aufzubauen, auch wenn dies kurzfristig Leistungseinbußen bedeutet.

Das Gegenargument ist schwerer zu entkräften, als es scheint. Wenn KI-Feedback objektiv Vorurteile reduziert, konsistentere Bewertungen liefert und Ergebnisse verbessert – ist Transparenz dann ein teures Luxusgut, das vor allem dafür sorgt, dass sich HR-Verantwortliche ethisch fühlen?

Keine der beiden Seiten kann auf Langzeitdaten verweisen, wie sich transparente KI-Feedback-Nutzung nach drei Jahren auswirkt. Die Technologie hat sich zu schnell entwickelt, und die Einsätze sind noch zu frisch. Aber die Entscheidung zeigt, was Führungskräfte über ihre Mitarbeitenden denken und was sie bereit sind zu opfern, um Ergebnisse zu erzielen.

Organisationen, die sich für Intransparenz entschieden, setzen darauf, dass Leistungsgewinne die spätere Vertrauenskrise wert sind. Wer auf Transparenz setzt, glaubt, dass KI-bereite Kulturen Ehrlichkeit über die Rolle von KI benötigen – auch wenn dies kurzfristig Leistung kostet.

Die Forschung zeigt, was unmittelbar nach der Offenlegung passiert. Was wir noch nicht mit derselben Sicherheit beantworten können, ist, welcher Ansatz auf lange Sicht robustere und leistungsfähigere Organisationen aufbaut.

Vorerst bleibt dies eine Frage der Philosophie, des eigenen Risikoverständnisses und der Art von Organisation, die Führungskräfte gestalten wollen.