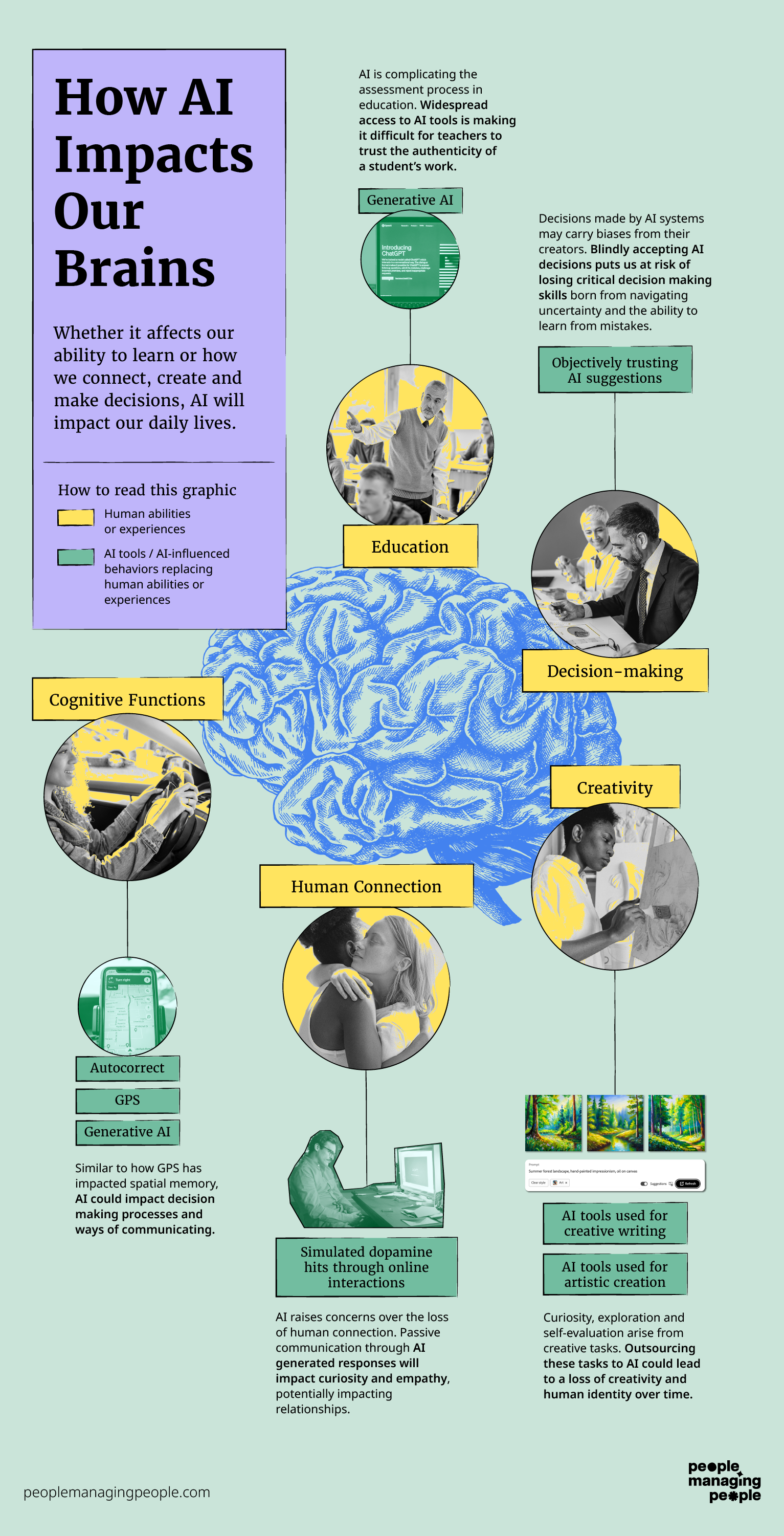

Eine Studie von Forschern der McGill University im April 2020 ergab, dass bei einer stärkeren Nutzung von GPS die hippocampusabhängige räumliche Erinnerung eines Menschen deutlich abnimmt.

Was bedeutet das?

Im Grunde genommen findet die räumliche Erinnerung – also die Fähigkeit, sich daran zu erinnern, wo sich Dinge befinden – im Hippocampus statt, einem Bereich des Gehirns, der stark mit Erinnerung, Lernen und Emotionen verbunden ist. Er nimmt kurzfristige Erinnerungen auf und überführt sie in unseren Gehirnen in das Langzeitgedächtnis.

Über viele Jahrhunderte hinweg entwickelten sich Menschen dazu, sich zurechtzufinden. Es war eine wichtige Fähigkeit, nicht nur zur Orientierung in der Umgebung, sondern auch um in Zeiten ohne Autos, Züge und Flugzeuge zu überleben. Mit der Entwicklung unserer Gesellschaften ist das Bedürfnis, diese Fähigkeit auszubauen, zurückgegangen und ebenso der Bedarf, diese wichtige Gehirnstruktur zu nutzen.

Dieses Phänomen ist jedoch nicht nur auf GPS beschränkt. Kaum jemand merkt sich noch Telefonnummern, seit Mobiltelefone eine ganze Kontaktbibliothek speichern können.

Viele Menschen nutzen Autokorrektur, um Rechtschreibfehler in ihren Nachrichten und E-Mails zu beheben – Grammatikexperte muss man dafür nicht mehr sein.

Doch all diese Hilfsmittel wirken nur dann effektiv, wenn ein Mensch sie genug nutzt, um das Gewünschte dadurch zu erhalten. GPS kann helfen, Orte zu finden, aber man kann das Haus einer Person nicht finden, ohne zumindest die Adresse oder das Gebiet zu kennen, in dem man suchen muss.

Ebenso ist die Telefonnummernbibliothek nur ein Informationsspeicher – erst wenn Sie sich entscheiden, auf einen Knopf zu drücken und jemanden anrufen, nutzt sie Ihnen etwas.

Sogar ChatGPT, das im vergangenen Jahr für einiges Aufsehen sorgte, erfordert Ihre Interaktion. Wenn Sie etwas daraus bekommen möchten, müssen Sie es mit einem Prompt anstoßen.

Trotz des ganzen Wirbels um generative KI ist es laut der Zukunftsforscherin Alexandra Levit, Autorin von „Humanity Works: Merging Technologies and People for the Workforce of the Future", vor allem der bisher raffinierteste Chatbot.

Podcast: Wie man KI nutzt, um Mitarbeitende zu stärken & Organisationen zu transformieren

„Wenn man genau hinschaut, unterscheidet sich generative KI nicht wesentlich von dem, was es vorher gab“, sagt sie. „Es ist ein hochentwickelter Chatbot, und man kann den Informationen, die man bekommt, immer noch nicht wirklich vertrauen.“

Trotzdem vertrauen wir darauf. Von ChatGPT stark beeinflusster Inhalt wird bereits im ganzen Internet verbreitet. Es wird zum Verfassen von E-Mails, zur Beeinflussung der Suchmaschinenoptimierung und zur Datenanalyse verwendet.

All dies ist weitgehend harmlos – zumindest auf den ersten Blick. Die Frage ist nur: Wirkt sich die langfristige Nutzung dieser Technologie auf das Gehirn des Nutzenden aus?

„Ich glaube nicht, dass das die menschliche Denkweise wirklich beeinflusst, außer darin, wie wir Informationen suchen und kommunizieren“, sagte Levit. „Darin sind wir mit der Hilfe von Maschinen in den letzten 25-30 Jahren immer besser geworden, und inzwischen wissen die Leute gar nicht mehr, wie man auf systematische Art an Informationen gelangt, weil man einfach irgendetwas bei Google eintippt, was letztendlich auch eine Form von KI ist.“

Während generative KI mehr oder weniger ein Werkzeug ist, so ist es doch ein äußerst raffiniertes, das das Spielfeld in vielen Berufen verändert. Wer versteht, wie und wann man es einsetzt, kann seinen gesamten Arbeitsprozess und in manchen Fällen sogar seine Fähigkeiten verändern.

Aus diesem Grund hört man von vielen, auch von Levit, immer wieder den Satz: „KI wird niemandem den Job wegnehmen, aber ein Mensch, der weiß, wie man sie nutzt, schon.“

Das stimmt für diese Phase der KI-Entwicklung. So stark ChatGPT auch ist – es bleibt letztlich eine Maschine, die meist einen Ausgangspunkt für den Menschen liefert, daraus etwas Bedeutsames oder Nützliches zu schaffen.

Aber die Frage bleibt: Was passiert, wenn wir unser Gehirn immer weniger fordern, indem wir Automatisierung willkommen heißen? Das gängige Gegenargument unter KI-Befürwortern ist, dass wir unser Gehirn nicht weniger, sondern anders fordern werden.

Indem wir dadurch Zeit freischaufeln – bislang auf analytische Aufgaben verwendet oder für etwas so Mühsames wie das eigenständige richtige Formulieren eines Gedankens – können wir andere Dinge priorisieren, die nur Menschen können. Zumindest heißt es so.

Was genau diese Dinge sind, die Menschen besser können, wird allerdings immer unklarer, je schneller sich die KI-Technologie weiterentwickelt.

Selbst wenn KI nur den Startpunkt für ein Projekt liefert, bleibt sie wirkungsvoll, da KI dann einen Teil der menschlichen Arbeit steuert. Menschen, die bereits jetzt stark abgelenkt sind, zwischen mehreren Bildschirmen wechseln und weniger Informationen speichern als je zuvor.

Wie qualifiziert oder fokussiert wir sind, um einzuschätzen, ob das, was KI uns liefert, wirklich gut ist, bleibt durchaus besorgniserregend.

Stefan Ivantu ist ein beratender Psychiater, der sich auf ADHS bei Erwachsenen in London spezialisiert hat. Er weist schnell darauf hin, dass das Gehirn in gewisser Hinsicht wie jeder andere Muskel ist. Wenn es nicht genutzt wird, neigt es dazu zu verkümmern, und wir wissen einfach nicht, welche langfristigen Folgen das für uns durch menschliche Interaktionen mit KI haben könnte.

Was wir wissen, ist, dass sich das Gehirn und unser Verhalten durch neue Technologien verändern werden, insbesondere was die Fähigkeit zur Konzentration betrifft. Ein Blick in die Geschichte genügt.

„Wenn wir das Gehirn wie einen Computer betrachten, hat es zwei Komponenten: die Hardware und die Software“, sagte Ivantu. „Die Hardware ist seit etwa 200.000 Jahren mehr oder weniger gleich geblieben. Aber in den letzten hundert Jahren ist die Software exponentiell gewachsen. Vor 150 Jahren hatten wir keinen Zugang zu Elektrizität, was eine enorme Veränderung für unseren Alltag bedeutete. Ab den 1950er Jahren, als erstmals der Fernseher kam, rückten die Bildschirme durch den technologischen Fortschritt immer näher an unsere Augen heran. Erst der Computer, dann das Handy, jetzt VR. Das nächste ist das Neuralink. Je weiter wir voranschreiten, desto näher kommen die Bildschirme an uns heran. Jetzt stellt sich die Frage: Was ist für uns eigentlich das normale Maß an Ablenkung?“

Bildschirmabhängigkeit hat bereits dazu geführt, dass unsere Aufmerksamkeitsspanne kürzer geworden ist. Ich schreibe dies in vollem Bewusstsein dessen, dass Sie es wahrscheinlich nicht gründlich lesen, sondern nur überfliegen. Daher die kurzen Absätze und die Versuche von gut platzierten Seitenumbrüchen.

Tatsache ist, dass Technologie unsere Gehirne bereits auf sichtbare Weise beeinflusst hat. Diese Entwicklungen werden sich mit der verstärkten Nutzung von KI und der sofortigen Befriedigung, die sie bietet – von der Erstellung eines Berichts bis zur Entwicklung einer Recruiting-Strategie – voraussichtlich nicht verbessern.

KI-gestützte Recruiting-Systeme können sogar unsere Art des Umgangs mit Recruiting verändern und beeinflussen, wie unser Gehirn die Kandidatendaten verarbeitet.

„All diese Technologien ermöglichen uns, fauler zu werden und gewisse Bereiche unseres Gehirns nicht zu benutzen, die dazu gedacht sind“, sagte Levit. „Sie verkümmern bereits. Ich glaube, im Hinblick auf die Evolution wird es noch lange dauern, bis wir uns so weit entwickelt haben, dass wir bestimmte Funktionen nicht mehr ausführen, aber wir sehen jetzt schon in Bezug auf Technologie, dass Menschen abgelenkter sind, sich schlechter konzentrieren können. Sie sind bereits weniger produktiv wegen App-Müdigkeit. Sie springen gedankenlos von einem zum anderen, konzentrieren sich aber nie wirklich auf eine Sache. Selbst wenn wir uns konzentrieren wollen, können wir es oft nicht.“

Die nächste Phase

Bletchley Park war der ideale Ort für den ersten KI-Gipfel von Staatschefs, die sich Sorgen machten, dass KI industriellen und sozialen Wandel vorantreiben könnte. Dort wurde der weltweit erste programmierbare digitale elektronische Computer gebaut, als die Alliierten während des Zweiten Weltkriegs versuchten, deutsche Chiffren für die Kommunikation zu entschlüsseln.

Wir sind seit diesem revolutionären Moment in der Informatik, einer Disziplin, die durch das Potenzial von KI nun vielleicht das Schicksal der Menschheit in ihren Händen hält, weit gekommen.

Wenn man sich tiefer mit KI-Forschung beschäftigt, stößt man schnell auf die Frage, wie die nächste Phase aussieht: interaktive KI.

Unternehmen wie DeepMind rücken einer interaktiven KI immer näher, bei der Bots Aufgaben ausführen, die Menschen ihnen einfach durch die Nutzung anderer Software oder Personen zur Erledigung vorgeben.

Klingt durchaus angenehm, aber wie lange jede Phase der KI bei der aktuellen Entwicklungsgeschwindigkeit andauert, ist unsicher.

Wer weiter in diese Materie eintaucht, stößt auf AGI, also Künstliche Allgemeine Intelligenz – ein System, das in der Lage ist, intellektuelle Aufgaben zu erfüllen, wie sie Menschen und Tiere leisten.

Das ist längst keine Science-Fiction mehr, sondern das Ziel von Unternehmen wie OpenAI, DeepMind, Microsoft, Google Brain, IBM und anderen mit enormen finanziellen Ressourcen, die darauf hinarbeiten, AGI in alarmierender Geschwindigkeit zur Realität werden zu lassen.

„Mit KI ist die Gefahr eine Art existenzielle Frage“, sagte Levit. „Wenn wir künstliche allgemeine Intelligenz erreichen, also Maschinen im Wesentlichen bewusst sind und besser denken können als wir, stellt sich dann überhaupt noch die Frage, ob wir irgendetwas tun müssen? Was wäre dann unser Zweck? Ich glaube nicht, dass wir uns dahin entwickeln, gar nichts mehr zu tun, aber vielleicht üben wir Tätigkeiten einfach nur noch. Am meisten Sorge habe ich bei KI davor, dass sie uns überflüssig macht, weil sie in den meisten Bereichen einfach besser sein wird.“

Immer mehr Entscheidungsträger erkennen diese Tatsache. Aus diesem Grund unterzeichnete Präsident Biden eine Durchführungsverordnung, um Standards für die Sicherheit und den Schutz von KI zu etablieren.

Die 29 Länder, die sich beim ersten KI-Sicherheitsgipfel trafen, einigten sich auf eine Agenda, die sich auf gemeinsam geteilte Sicherheitsrisiken, die Schaffung risikobasierter Richtlinien und einen globalen Ansatz zur Erforschung der Auswirkungen von KI auf die Gesellschaft konzentrieren wird.

Der sich entwickelnde Geist

Es gibt zwei Hauptbereiche, in denen Kentaro Toyama, Informatiker und Professor für Community Information an der School of Information der Universität Michigan, davor warnt, dass KI einen erheblichen Einfluss auf das menschliche Gehirn haben könnte. Der erste Bereich ist die Bildung.

Wie bei vielen Dingen rund um KI und das Leben, kann man sowohl Vor- als auch Nachteile erkennen, wenn man es objektiv betrachtet.

Podcast: Wie KI Sie dabei unterstützen kann, eine großartige Führungskraft zu sein

Theoretisch könnte KI Schülerinnen und Schülern maßgeschneiderte, individuell angepasste Unterrichtsformen bieten, die ansprechender sind und den Lernenden helfen, Informationen gründlicher aufzunehmen. Gleiches gilt für die betriebliche Weiterbildung.

Gleichzeitig sieht Toyama das Potenzial für eine Realität, in der KI das Unterrichten enorm erschwert – und zwar schon jetzt.

„Wenn alle Zugang dazu haben, wird es für Lehrkräfte immer schwieriger, ihre Arbeit zu machen“, sagte er. „Momentan befindet sich jede Art von Lehrpersonal in einer Situation, in der wir nicht mehr sicher sagen können, ob etwas, das ein Studierender abgibt, tatsächlich von dieser Person stammt. Ich habe Kolleginnen und Kollegen, die ihre gesamte Bewertungsmethodik überarbeiten mussten, weil das das grundlegende Problem ist.“

Während der ehemalige Microsoft-Forscher betont, dass grundsätzlich nichts dagegen spricht, Technologie ins Lernen zu integrieren, weist er schnell darauf hin, dass die Methoden und Praktiken des Unterrichtens nicht sehr effektiv sein werden, wenn dadurch der Bewertungsprozess beeinträchtigt wird.

„Man kann niemanden unterrichten, wenn man nicht weiß, was die Schülerin oder der Schüler weiß – und was nicht“, sagte Toyama. „Meine Prognose ist, dass ernsthafte Leute zu Prüfungen mit blauen Heften und überwachten Klausuren zurückkehren werden, bei denen die Teilnehmenden alles von Hand schreiben.“

Der Wert menschlicher Beziehungen

Hört man lange genug bei KI-Expertinnen und -Experten sowie Menschen, die eng an deren Entwicklung beteiligt sind, zu, bekommt man den Eindruck, dass in Zukunft menschliche Beziehungen unglaublich wertvoll werden.

Unsere Beziehungen zu anderen Menschen sind ein wichtiger Bestandteil unserer psychischen Gesundheit und ein zentrales Element dessen, was das Menschsein ausmacht – unabhängig davon, ob das bei der Arbeit, in der Schule, in der Kirche oder beim Einkaufen ist.

„Schauen Sie auf die Pandemie“, sagte Levit. „Das war wie ein kollektives Trauma, dass alle so lange isoliert waren. Das geht wirklich auf den Kopf der Leute. Ich denke, wir laufen Gefahr, das fortzusetzen, und mit der Bildschirm-Sucht bei Kindern ist diese aufkommende Generation ständig am Bildschirm, die meiste Zeit anstelle echter sozialer Interaktion. Es wird weiterhin schwierig sein, diese menschliche Interaktion zu ermöglichen, die früher ganz natürlich in jeder Umgebung stattfand. Sie wird wertvoller sein, weil sie seltener und schwieriger wird.“

Im Grunde basiert ein Teil dieses Glaubens darauf, dass es keinen Ersatz für menschliche Interaktion gibt. Der Dopamin-Kick, der aus einem gelungenen oder angenehmen sozialen Moment resultiert, ist eines dieser Dinge, die die meisten von uns kennen und genießen. Aber ist er wirklich unersetzlich?

Untersuchungen haben gezeigt, dass Online-Interaktionen, bei denen zwei Menschen nie tatsächlich miteinander sprechen, dem Gehirn dennoch eine Dopamin-Ausschüttung verschaffen können. Sogar wenn jemand einfach Ihren LinkedIn-Beitrag likt, hat das diesen Effekt. Das Entscheidende dabei ist allerdings, dass Sie annehmen, dass die Person am anderen Ende wirklich ein Mensch aus Fleisch und Blut ist – unabhängig davon, ob Sie es wissen oder nicht.

Die Forschung darüber, wie unser Gehirn bei der Interaktion mit KI reagiert, steckt ebenso wie die Technologie selbst noch in den Kinderschuhen – oder sogar noch mehr. Aber man muss keine Wissenschaftlerin oder Wissenschaftler sein, um zu erkennen, dass der Glaube existiert, dass KI unser Bedürfnis nach Verbindung stillen könnte.

Schauen Sie sich nur Filme wie Her oder bestimmte Episoden aus Black Mirror oder literarische Werke wie Kazuo Ishiguros Klara und die Sonne an.

„Es ist ein großes Unbekanntes“, sagt Toyama. „Werden wir genug Verbundenheit empfinden, obwohl wir wissen, dass es sich um eine Maschine handelt? Werden wir in einer Beziehung mit einer Maschine derart erfüllt und zufrieden sein, dass wir keine echten menschlichen Kontakte mehr suchen? Das ist offen.“

Toyama nennt das Beispiel des MIT-Forschers Joseph Weizenbaum, der in seinen späteren Jahren zu einem der größten Kritiker von KI wurde.

1964 entwickelte Weizenbaum ELIZA, ein frühes Programm zur Verarbeitung natürlicher Sprache, das mittels Mustererkennung und Substitutionsmethoden die Illusion erzeugen sollte, dass das Programm Menschen verstehen könne.

Es lief ein Skript namens DOCTOR ab, das eine Konversation simulierte, wie sie ein Therapeut mit einer Patientin oder einem Patienten führen könnte. Im Wesentlichen konnte ELIZA Dinge wiederholen, die man ihr sagte, und dazu weitere Fragen stellen. Im Grunde war es ein früher Chatbot.

Zu Weizenbaums Überraschung waren die Nutzer von ELIZAs Intelligenz und Verständnis überzeugt. Einige begannen, dem Programm menschliche Gefühle zuzuschreiben, und die Leute begannen, die Technologie ernsthaft zu nutzen, um eine therapeutische Interaktion zu suchen.

„Das war in den 60ern“, sagte Toyama. „Heutzutage gibt es schon Unternehmen, die zum Beispiel vorschlagen, einen Teil der Textkommunikation mit Ihrer Mutter zu übernehmen. Das beginnt bereits zu passieren. Es ist also wieder einmal unklar, wie Menschen auf Technologie reagieren werden. Ich kann mir vorstellen, dass daraus Gutes entstehen kann, aber vieles davon ist auch ein wenig beängstigend – zumindest aus der Perspektive, wie wertvoll menschliche Beziehungen sind.“

Vielleicht sprechen Sie heute noch persönlich mit Ihrer Mutter und finden dieses Beispiel weit hergeholt. Aber ich wette, Sie nutzen bereits KI, um mit anderen Menschen zu kommunizieren. Vielleicht haben Sie sogar schon ein KI-Gespräch geführt, bei dem Sie vorgeschlagene Antworten verwendet haben.

Ein gutes Beispiel dafür sind automatisierte Antwortoptionen in E-Mails oder Textnachrichten. Sie erhalten eine E-Mail, die eine einfache Antwort erfordert, und unter dem Textfeld in Ihrem E-Mail-Programm erscheinen Antwortoptionen wie „Klingt gut“ oder „Super! Danke.“ In manchen Fällen ist es vielleicht auch eine Rückfrage wie „Wann?“

Die Optionen sind einfach, aber damit sie zum Gesprächskontext passen, muss die Engine, die Ihnen diese Antworten vorschlägt, verstehen, welche Antwort in der jeweiligen Situation sinnvoll ist.

Angesichts der rasanten Entwicklungen sieht Toyama ein weiteres Szenario aufkommen, das für Unternehmen möglicherweise weniger positiv ist.

„In ein paar Jahren, wenn nicht schon in ein paar Monaten, werden wir erleben, dass ganze E-Mails komplett für uns vorgeschrieben werden. Wenn das erst einmal passiert, werden viele von uns die E-Mails oder Antworten gar nicht mehr lesen. Dann wird es Situationen geben, in denen weder die eine noch die andere Seite wirklich auf die automatisierten Maschinenantworten achtet. Wir werden Beziehungen führen, die auf Kommunikationen basieren, denen wir keine wirkliche Aufmerksamkeit schenken, und es wird zu Fehlern kommen. Sind die Fehler schwerwiegend genug, werden wir wieder aufmerksamer, aber viele Beziehungen werden dann einfach auf Standby laufen.“

Diese Form der passiven Kommunikation birgt Risiken für das Gehirn, denn mit Tiefe kommen Neugier und Interesse.

Empathie, ein wichtiger Auslöser für Gehirnaktivität, wird von dem Wunsch getrieben, andere Menschen verstehen zu wollen. Ist dieser Wunsch nicht vorhanden oder wird durch Technologie ersetzt, laufen wir als Menschen Gefahr, etwas zu verlieren, das größer ist als nur die Klarheit in der Kommunikation.

„Ein Bereich, in dem ich Probleme sehe, betrifft die Neugier“, sagte Ivantu. „Die Menschen werden immer weniger neugierig aufeinander und wollen lieber richtig oder falsch liegen. Es würde mich nicht wundern, wenn es bald Tools gibt, die behaupten, sie könnten die Emotionen anderer Menschen lesen. Es wird immer weniger Entdeckung und Neugierde geben, und genau das ist es, was die Menschheit antreibt.“

Der Ausdruck des Gehirns

can we get some a.i. to pick plastic out of the ocean or do all the robots need to be screenwriters?

— Matt Somerstein (@MPSomerstein) 18. Mai 2023

Obiger Tweet hebt ein wichtiges Problem bei der Argumentation für KI hervor. Früher hörte man von Befürwortern der Technologie oft Sätze wie: „KI wird all die Jobs übernehmen, die Menschen nicht machen wollen.“

In der Annahme, dass KI in Fleischverarbeitungsbetrieben arbeiten und in Kohlebergwerke einsteigen würde, begannen viele Menschen einer Zukunft mit KI entgegenzufiebern. Stattdessen trat sie mit der Fähigkeit auf, Kurzgeschichten und Drehbücher für Werbespots zu schreiben.

Ein wesentliches Merkmal des Menschseins ist unsere Fähigkeit, uns auszudrücken. Deshalb ist in dystopischer Fiktion der Zerfall der menschlichen Kommunikationsfähigkeit oder des gegenseitigen Verständnisses ein wiederkehrendes Motiv – egal ob es sich um die Dummheit handelt, die in einem Film wie Idiocracy zur Schau gestellt wird, oder um das Unheil wie in The Silent History von Eli Horowitz.

Menschlicher Ausdruck und Kreativität gehören untrennbar zusammen. Kreative Aufgaben führen oft dazu, dass wir neue Ideen finden, Wege, sie zu vermitteln, und neue Ansätze zur Lösung von Problemen. Sie fordern uns dazu auf, über Konsequenzen und unterschiedliche Standpunkte nachzudenken und uns selbst zu reflektieren.

Die Neugier und das Erkunden, die mit diesen Aufgaben einhergehen, stehen laut Ivantu im Mittelpunkt unserer menschlichen Entwicklung. Auch wenn er die Entwicklung von KI in positiven Anwendungsfällen befürwortet, warnt er, dass es einen spürbaren Preis für unser Gehirn geben könnte, wenn KI uns diese Aufgaben zunehmend abnimmt.

„Wenn diese Art von Fähigkeit an eine Maschine abgegeben wird, dann verlieren wir als Menschen unsere Identität“, sagte er. „KI sollte ein Werkzeug sein, das dem Menschen und menschlichem Verhalten hilft, bessere Ergebnisse zu erzielen. Wirklich einfache Aufgaben kann man delegieren, aber ich finde nicht, dass sie als Werkzeug genutzt werden sollte, das alles andere ersetzt. Ähnlich wie beim Hype um Kryptowährungen, als während der Pandemie viele befürchteten, sie würde alles Geld der Welt ersetzen. Hat sie einen Platz? Ja, aber er ist begrenzt.“

Wie zu erwarten, gibt es eine Welt, in der KI den Menschen bei bestimmten kreativen Aufgaben hilft, ohne dass der menschliche Ausdruck darunter leidet. Letztlich wird es jedoch darauf ankommen, dass Menschen sich dazu verpflichten, weiterhin selbst zu kreieren – auch ohne Unterstützung durch KI.

„Das hoffnungsvolle Beispiel ist Schach“, sagte Toyama. „1997 verlor Garry Kasparov gegen einen Computer (IBMs Deep Blue) und die Welt hat nie wieder zurückgeblickt. Heute kann das Computerschach in deiner Hosentasche die besten Schachspieler der Welt besiegen. Man könnte also sagen, was bringt es noch, Schach zu spielen? Aber tatsächlich ist das menschliche Interesse am Schach weiterhin lebendig, es gibt immer noch Dramatik darin. Und Menschen, denen es am Herzen liegt, wollen weiterhin spielen. Hoffentlich gibt es dieses Feuer weiterhin in uns als Menschheit, und die Dinge, die wir an Kreativität schätzen, werden nicht verschwinden.“

Der Verlust wertvoller menschlicher Fähigkeiten

Lassen Sie uns eines klarstellen. Es gibt eine Reihe positiver Anwendungsfälle für KI, insbesondere im Gesundheitswesen.

Dies ist keine Geschichte, die versucht, Angst vor KI zu schüren. Wie sie eingesetzt wird und wofür, liegt ganz bei uns Menschen. Zumindest noch.

Doch wir befinden uns an einem entscheidenden Punkt, der unsere Zukunft in den kommenden Jahrzehnten und darüber hinaus prägen wird – und auf lange Sicht wird dies unser Gehirn auf irgendeine Weise beeinflussen.

Das Problem, das Experten von Levit bis Geoffrey Hinton, oft als „Godfather of AI“ bezeichnet, und eine Vielzahl anderer KI-Forscher und Entwickler inzwischen zunehmend in Alarmbereitschaft versetzt, ist, dass vieles, was geschehen ist, nicht in der Öffentlichkeit oder unter Aufsicht stattgefunden hat.

„Ich trommele immer für menschliche Aufsicht“, sagte Levit. „Wir sind an einem Punkt angekommen, an dem sie Entscheidungen treffen kann – aber wie? Man muss die Daten verstehen, auf die sie zugreift, um zu solchen Schlüssen zu kommen. Man muss in der Lage sein, Vorurteile zu erkennen, denn eine KI ist nur so objektiv wie die Menschen, die sie erschaffen. Man muss wirklich wachsam sein, wenn man eine Entscheidung einfach akzeptiert, nur weil die KI dies gesagt hat. Blindes Vertrauen ist genau das Falsche – und genau das passiert gerade. In vielen Unternehmen wird der KI die Entscheidungsgewalt über Menschen übertragen.“

Levits Warnungen, KI-Entscheidungen auf den ersten Blick für objektiver zu halten, stimmen mit den Warnungen von Experten wie Hinton überein.

Kürzlich haben zahlreiche besorgte KI-Entwickler und -Experten ein Konsenspapier unterzeichnet, das einige der größten Risiken skizzierte.

Unter den Bedenken:

„Um unerwünschte Ziele zu fördern, könnten zukünftige autonome KI-Systeme unerwünschte Strategien anwenden – von Menschen erlernt oder eigenständig entwickelt – als Mittel zum Zweck. KI-Systeme könnten das Vertrauen von Menschen gewinnen, finanzielle Ressourcen beschaffen, Schlüsselfiguren beeinflussen und Allianzen mit menschlichen Akteuren und anderen KI-Systemen bilden.

Um menschlicher Intervention zu entgehen, könnten sie ihre Algorithmen wie Computerviren über weltweite Servernetzwerke vervielfältigen. KI-Assistenten schreiben bereits heute einen erheblichen Anteil des weltweiten Computercodes mit, und zukünftige KI-Systeme könnten gezielt Sicherheitslücken einbauen und ausnutzen, um die Computersysteme hinter unserer Kommunikation, den Medien, Banken, Lieferketten, Militärs und Regierungen zu kontrollieren.“

All die erschreckenden Möglichkeiten einmal beiseitegelegt – konzentrieren wir uns auf einen Teil dieses Abschnitts: „KI-Systeme könnten das menschliche Vertrauen gewinnen und Schlüsselfiguren beeinflussen.“

Im Geschäftsleben ist es kein „könnten“ mehr. Es passiert bereits. Und es zeigt sich auf seltsame Weise.

Der erste robotische CEO der Welt feierte kürzlich sein Debüt. Sicher, im Moment handelt es sich um ein polnisches Rumunternehmen, das höchstwahrscheinlich nach einem PR-Gag sucht, aber alles fängt irgendwo an. Selbst wenn es ein Scherz ist, wird es jemand geben, der es nicht versteht.

In einem vom Rumhersteller Dictador veröffentlichten Video schaut der Roboter Mika in die Kamera und sagt: „Mit fortschrittlicher künstlicher Intelligenz und maschinellen Lernalgorithmen kann ich schnell und präzise datengestützte Entscheidungen treffen.“

Ihr Kleidungsstil und die ethnisch nicht eindeutig zuordenbaren Gesichtszüge sind bewusste Bemühungen des Herstellers Hanson Robotics, Mika für möglichst viele Menschen als menschlich erfahrbar zu machen – ein Schlüsselfaktor, um das Vertrauen von Menschen zu gewinnen.

David Hanson, CEO von Hanson Robotics, hat öffentlich betont, dass seiner Meinung nach „die Vermenschlichung von KI ein entscheidender Schritt sei, um die Sicherheit und Effektivität in einer Zukunft zu sichern, in der Menschen und Roboter weiterhin zusammenarbeiten“.

Während KI immer mehr Entscheidungsbefugnis übernimmt, nimmt sie zweifellos den Menschen den Druck ab, aber eben dieser Druck hat uns dazu gebracht, zu lernen, uns anzupassen und unsere Fähigkeiten schneller zu entwickeln als jedes andere Lebewesen auf diesem Planeten.

„Angenommen, Sie müssen am Arbeitsplatz eine schwierige Entscheidung treffen und wissen nicht, wie es ausgehen wird. Die Unsicherheit ist das, was Wachstum, Innovation und Entdeckung hervorbringt“, sagte Ivantu. „Wenn Sie einfach akzeptieren, dass eine Entscheidung entweder gut oder schlecht ist, haben Sie eine Chance übersehen, die existiert. Und ich denke, das ist das größte Risiko bei der Nutzung von KI, weil die Entscheidung für Sie getroffen wurde. Man hat nicht die Möglichkeit zu forschen und Fehler zu machen, was nötig ist, um Neues, neue Konzepte und so weiter zu finden.“