Problèmes de confiance: Les Américains craignent davantage que l’IA soit mal utilisée par les dirigeants que l’IA elle-même, révélant des problèmes de confiance plus profonds.

Sentiments au travail: Les travailleurs évaluent l’IA à travers les actions des dirigeants et le passé d’abus de pouvoir, et non ses mérites techniques.

Comparaison avec l’UE: Les Européens partagent les mêmes appréhensions quant à l’IA, mais bénéficient de cadres réglementaires dont les travailleurs américains sont dépourvus.

Confiance envers l’employeur: Les employeurs américains inspirent plus de confiance que d’autres institutions, mais cette confiance reste fragile et inégale.

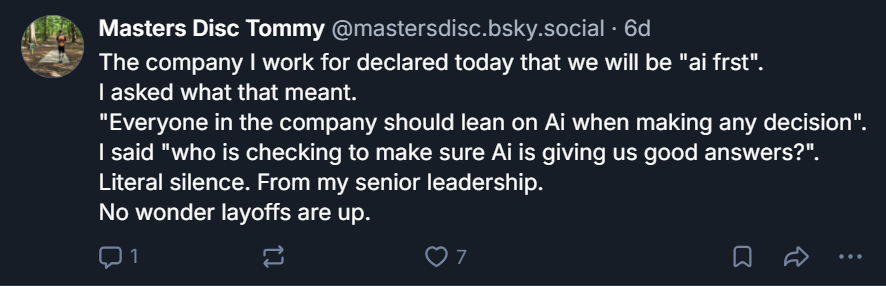

Stratégies de direction: L’adoption réussie de l’IA exige transparence et implication à tous les niveaux de l’entreprise.

Plus je parle avec des gens, peu importe leur secteur d’activité, plus une chose devient claire : les Américains n’ont pas peur de l’IA, ni de la technologie en général. Ils ont peur de ce que les décideurs vont en faire.

Cette distinction compte plus que n’importe quel indicateur ou lancement de produit, car elle reconfigure entièrement la conversation sur l’adoption de l’IA au travail. Le discours dominant considère la résistance à l’IA comme un problème d’alphabétisation, que l’on pourrait résoudre par une meilleure formation et une intégration optimisée. Mais les données racontent une histoire différente.

L’anxiété qui s’empare des travailleurs américains s’explique par des décennies de promesses non tenues de la part des institutions qui les emploient, les gouvernent et prétendent défendre leurs intérêts.

Le Baromètre de confiance Edelman 2025 classe les États-Unis parmi les cinq grandes économies les moins confiantes au monde, avec un indice de confiance de 47 sur 100. Le Japon, l’Allemagne, le Royaume-Uni et la France complètent ce groupe.

Soixante et un pour cent des personnes interrogées dans le monde déclarent ressentir un grief modéré ou élevé, c’est-à-dire qu’elles pensent que le gouvernement et les entreprises servent des intérêts étroits alors que les citoyens ordinaires peinent. Aux États-Unis, le constat est encore plus marqué : trois fois plus d’Américains rejettent l’essor de l’IA qu’ils ne l’acceptent, 49 % contre 17 %.

Ces chiffres ne décrivent pas une population dépassée par la technologie. Ils décrivent une population qui a vu pendant une génération les dirigeants d’entreprise promettre trop et tenir trop peu, et qui considère désormais l’IA comme le nouveau moteur de ce cycle.

Les données du monde du travail vont dans le même sens. L’index TrustID de Deloitte a enregistré une chute de 31 % de la confiance dans l’IA générative fournie par les entreprises entre mai et juillet 2025. La confiance dans les systèmes d’IA agentiques, capables d’agir de façon autonome (et non seulement de recommander), s’est effondrée de 89 % sur la même période.

Les travailleurs n’évaluent pas la technologie sur ses mérites techniques. Ils l’évaluent en fonction de qui la contrôle et de ce que ces personnes ont fait par le passé avec leur pouvoir.

Le sondage flash d’Edelman sur l’IA, mené dans cinq pays fin 2025, révèle que les salariés sont 2,5 fois plus enclins à adopter l’IA lorsqu’ils estiment que la sécurité de leur emploi s’améliore. Deux personnes sur trois défiant l’IA déclarent que son adoption leur est imposée, pas volontaire. Et, interrogés sur la personne en qui ils ont confiance pour dire la vérité sur l’IA, les salariés choisissent leurs pairs plutôt que les PDG ou les responsables politiques dans une proportion de deux pour un.

Ce dernier constat est une accusation discrète. Les salariés ne veulent pas entendre parler de l’IA par la direction. Ils veulent en entendre parler par quelqu’un qui travaille à leurs côtés et n’a rien à gagner à enjoliver le message.

Une peur d’un autre genre

Comparez cela à l’Europe. Les Européens ne sont pas particulièrement enthousiastes à propos de l’IA non plus. L’Allemagne et le Royaume-Uni figurent tous deux dans le bas de l’index de confiance. Mais les salariés européens évoluent dans une structure fondamentalement différente. Quelques différences clés :

- Le règlement AI Act de l’UE réglemente les applications de l’IA à haut risque dans l’emploi

- Les comités d’entreprise donnent aux salariés une voix officielle sur la manière dont la technologie est introduite

- Des pays comme l’Allemagne et la France exigent des consultations avant des licenciements collectifs

- La Confédération européenne des syndicats plaide pour une directive spécifique sur les systèmes algorithmiques au travail, incluant une supervision humaine obligatoire des décisions prises par l’IA et des droits de négociation collective concernant leur déploiement.

L’UE travaille également à ce que les défenseurs des politiques appellent un « Pacte social pour l’IA », un cadre lié au Fonds social européen conçu pour accompagner les travailleurs avec des aides financières, de la formation et un accompagnement à la reconversion lors des perturbations dues à l’IA. Le Fonds d’ajustement à la mondialisation, déjà existant en Europe, offre un modèle – même s’il est sous-financé – pour aider les travailleurs déplacés à rebondir.

Cela ne signifie pas pour autant que les salariés européens sont sereins face à l’IA. Mais leur anxiété prend une forme différente. Ils s’inquiètent de la surveillance, de la confidentialité des données, des empiètements des entreprises. Ils canalisent leurs craintes à travers des cadres réglementaires et des structures de négociation collective qui, bien que parfaits, leur offrent une place à la table. Lorsqu’un salarié allemand apprend que l’IA pourrait transformer son poste, il peut raisonnablement s’attendre à ce que l’État ou son syndicat ait au moins réfléchi à la suite.

Les salariés américains, eux, n’ont aucune attente de ce genre. Les enjeux structurels sont bien plus élevés aux États-Unis, où l’accès à la santé est lié à l’emploi. Perdre son travail, c’est perdre bien plus que son revenu : c’est perdre tout filet de sécurité.

Aux États-Unis, l’emploi est généralement à volonté. Le taux de syndicalisation est proche de son minimum historique. Il n’existe aucun cadre fédéral régissant l’IA sur le lieu de travail. Lorsqu’un salarié américain apprend que l’IA pourrait transformer son poste, la question légitime est : et ensuite ? Qui va m’aider ?

La réponse, de plus en plus, c’est personne. Et les travailleurs le savent bien.

L’employeur comme dernier recours

C’est là que l’histoire se complique pour les décideurs qui lisent cet article. Même si la confiance envers le gouvernement et les médias s’effondre, les employeurs restent l’institution la plus digne de confiance aux États-Unis.

Selon l'enquête menée par McKinsey auprès des employés en 2024, 71 % des travailleurs font confiance à leur propre employeur pour déployer l'IA de manière éthique, un taux supérieur à celui accordé aux universités, aux grandes entreprises technologiques ou aux startups. Les données d’Edelman montrent que 66 % des employés font confiance à leur employeur pour agir correctement. Ce chiffre reste stable, quel que soit l'âge, le genre, le revenu ou l’orientation politique.

Mais cette confiance demeure fragile. À l'échelle mondiale, la confiance envers les employeurs a chuté de 3 points en 2025, la première baisse significative depuis que les employeurs ont pris la première place en 2021. Et cette confiance est répartie de façon inégale. Edelman a constaté un écart de 13 points entre les travailleurs du quartile de revenu le plus bas et celui du plus élevé. Soixante-cinq pour cent des Américains appartenant au quartile de revenu inférieur pensent qu'ils seront laissés pour compte par l’IA. La moitié des répondants de la classe moyenne partagent ce sentiment.

Whitney Munro, PDG et fondatrice de FLEX Partners, observe cette tendance en temps réel. Elle déclare :

Dans les organisations que nous conseillons, les résultats de l'adoption de l'IA dans les différents secteurs correspondent presque parfaitement aux niveaux de confiance existant déjà entre la direction et les employés.

Là où les employés ont eu le sentiment d’avoir été informés de façon honnête lors de périodes de changement précédentes, ils se montrent plus optimistes et prêts à donner une chance à l’IA. À l’inverse, si les décisions ont été prises en vase clos sans communication, l’IA devient, selon elle, « un paratonnerre du conflit ».

C’est alors que les employés commencent à se demander si cette mise en place concerne vraiment la productivité ou bien la réduction des effectifs, et ils finissent par se sentir remplaçables.

Les personnes prises au milieu de cette tension sont les vice-présidents, directeurs et cadres supérieurs chargés de relayer le message à la base.

Kelly Meerbott, coach en leadership, PDG de You Loud and Clear et intervenante TEDx sur la sécurité psychologique, les décrit comme des « amortisseurs humains » entre les priorités du comité de direction et la réalité vécue du personnel.

Ils sont épuisés, dit-elle. À force de devoir traduire les éléments de langage de la direction en quelque chose de crédible pour leurs équipes. Et quand ces cadres intermédiaires ne croient pas eux-mêmes au message, toute la chaîne de confiance s’effondre avant même que l’IA n’atteigne les premiers employés.

La manière dont un DRH ou un COO gérera cette tension au cours des deux prochaines années déterminera si l'IA deviendra un exercice de renforcement de la confiance ou la rupture finale.

Les données d’Edelman offrent un indice quant à ce qui fonctionne. La communication entre pairs à propos de l’IA est environ deux fois plus efficace qu’un message descendant. L'adoption volontaire surpasse les déploiements obligatoires. Et le facteur le plus déterminant de la confiance envers l’IA est l’expérience personnelle, en particulier celle de voir l’IA réellement aider quelqu’un à mieux accomplir son travail.

Cela signifie que la voie à suivre tient moins aux stratégies élaborées qu’à l’expérience quotidienne du travail. Est-ce que la personne dans l’entrepôt ou dans le bureau régional de vente croit que l’outil d’IA récemment déployé par son entreprise, que ce soit pour des tâches courantes ou pour les processus d’évaluation de la performance, est vraiment là pour améliorer sa vie ? Ou croit-elle qu’il servira seulement à justifier la suppression de son poste dans dix-huit mois ?

La technologie ne répond pas à cette question. C’est la relation entre l’employeur et le salarié qui le fait. Or, dans un pays où la confiance envers les institutions décline depuis des décennies, cette relation porte un poids qui ne lui était jamais destiné.

La confiance suit les personnes, pas les plateformes

Les recherches font émerger un schéma qui devrait orienter les dirigeants. La confiance envers l’IA ne commence pas avec l’IA. Elle obéit à une logique plus ancienne, profondément humaine.

Les gens adoptent ce qu’ils se sentent assez en sécurité pour explorer. Ils explorent ce qu’une personne en qui ils ont confiance a déjà essayé. Et ils s’engagent lorsque l’expérience vient confirmer ce qu’on leur a dit, à savoir que l’outil est là pour les aider, et non pour les remplacer.

Cette séquence mérite d’être étudiée, car elle va à l’encontre de l’approche adoptée par la plupart des entreprises lors du déploiement d’une nouvelle technologie. La démarche classique part du sommet : annonce par la direction, formation générale, indicateurs d’adoption, intégration dans l’évaluation des performances.

Chacune de ces étapes renforce le rapport de force que les travailleurs redoutent déjà. Cela leur donne le sentiment que l’IA leur est imposée, et non construite avec eux. Dans un contexte où deux tiers des réticents sentent déjà qu’on leur force la main, cette méthode n’est pas seulement inefficace. Elle aggrave le problème.

David Kolodny, cofondateur du startup studio Wilbur Labs, qui a créé et investi dans plus de 21 entreprises technologiques depuis 2016, partage cette vision du côté créateur.

Une conviction forte que j’ai développée en travaillant avec l’automatisation depuis si longtemps est que les fondamentaux restent tout aussi essentiels qu’auparavant, dit-il. L’automatisation exige une mise en place réfléchie, un contrôle qualité rigoureux et une surveillance continue minutieuse.

Se précipiter pour déployer, en d’autres termes, c’est là où la confiance s’effondre. « Il est infiniment plus facile de briser la confiance que de la construire, » ajoute Kolodny, « et c’est pourquoi tant de personnes restent tièdes devant la technologie. »

Munro estime que le changement doit être plus fondamental qu’une question de rythme.

Vous ne pouvez pas déployer l’IA comme une simple mise en place technologique, dit-elle. Cela doit être culturel.

Cela signifie que les dirigeants doivent prendre des mesures très claires :

- Préciser explicitement à quoi l’IA servira et ce pour quoi elle ne sera pas utilisée.

- Éclaircir si des réductions d’effectifs font partie de la stratégie à long terme, plutôt que de laisser les employés combler le silence avec leurs pires suppositions.

- Impliquer les équipes dans les premiers tests pour qu’elles fassent partie du processus, et être honnête sur les compromis, plutôt que de célébrer les gains de productivité que les salariés soupçonnent de se faire à leurs dépens.

- Vérifier que vos actions sont alignées avec les valeurs, notamment en matière de surveillance. Utiliser l’IA à des fins de « flicage » détournera immédiatement les employés et alimentera toutes leurs craintes.

Ce que suggèrent les données sur la confiance derrière tout cela est en réalité presque d’une simplicité trompeuse. Commencez petit. Laissez les gens s’inscrire volontairement. Identifiez les salariés réellement curieux, pas ceux qui n’affichent qu’un enthousiasme de façade pour la direction, et donnez-leur de l’espace pour expérimenter sans fiche d’évaluation.

Quand ces personnes reviennent dire à leurs collègues qu’un outil leur a fait gagner deux heures sur un rapport ou leur a permis de repérer un schéma qu’ils auraient manqué, ce témoignage pèse bien plus que n’importe quelle présentation magistrale parce qu’il est dénué d’arrière-pensée.

Plaidoyer pour l’incertitude

Les cadres dirigeants doivent aussi accepter de dire ce qu’ils ignorent. Les données Edelman révèlent que deux tiers des employés des pays développés pensent que les leaders d’entreprise ne seront pas entièrement honnêtes sur l’impact de l’IA sur l’emploi. Cette attente d’un manque de franchise est déjà intégrée.

La seule façon d’y remédier est une transparence radicale sur ce que l’IA changera, ce qu’elle ne touchera pas, et les zones où l’entreprise n’a réellement pas encore de réponse. Meerbott va droit au but.

Dites aux autres dirigeants que vous êtes confus, ou que vous n’avez pas la réponse, dit-elle. « Choquez-les par votre humanité. »

Ce conseil contredit des décennies de formatage des cadres supérieurs, mais il correspond parfaitement à ce que révèlent les données sur la confiance. La plupart des dirigeants sont formés à projeter de la certitude. Dans ce contexte, la certitude sent la communication. Admettre son incertitude, tout en s’engageant à chercher des réponses aux côtés des salariés plutôt que du haut de la pyramide, est une posture bien plus crédible que n’importe quel récit de transformation soigneusement préparé.

L’anxiété américaine face à l’IA est un artefact culturel, le produit d’une société qui a systématiquement démantelé les structures censées rassurer les individus en période de bouleversement. L’Europe a mis en place des garde-fous avant de faire démarrer la voiture. Les États-Unis demandent aux salariés de faire confiance au conducteur alors que la voiture accélère, même si le parcours du conducteur reste tout au plus mitigé.

Je ne pense pas que les Américains aient intrinsèquement plus peur de l’IA que leurs homologues, affirme Munro. Je crois simplement que nous sommes plus méfiants à l’égard des structures de pouvoir qui n’ont pas prouvé de manière constante la confiance et la réciprocité.

Ce scepticisme ne vient pas de nulle part. Il a été alimenté par l’expérience. Pour les DRH et DOP qui traversent cette période, c’est l’environnement de base.

Chaque déploiement d’IA, chaque décision d’automatisation, chaque restructuration de personnel est filtré à travers un déficit de confiance qui existait bien avant que quiconque ne saisisse une invite dans ChatGPT. Reconnaître ce déficit est la première étape. Le combler sera le défi de la prochaine décennie.