Retour IA: Les retours générés par l’IA améliorent davantage les performances des employés que ceux d’un humain, mais seulement si l’origine reste cachée.

Effet de la révélation: Révéler que les retours proviennent d’une IA suscite de la résistance et nuit à la performance en raison de problèmes de confiance.

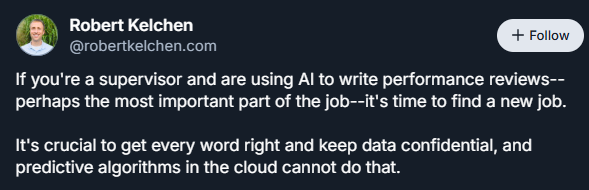

Crise de confiance: La confiance des employés envers l’utilisation de l’IA par les employeurs est faible, beaucoup la considérant comme un facteur d’accentuation des biais.

Stratégie de transparence: Il est conseillé de divulguer ouvertement l’utilisation de l’IA dans les processus de retour pour éviter des problèmes de confiance à long terme.

Impact à long terme: Le choix entre transparence et opacité reflète les valeurs de l’organisation et influe sur sa résilience.

Les meilleurs systèmes de feedback sur la performance fonctionnent comme un tour de magie à un certain égard : ils sont les plus efficaces lorsque l’on ne sait pas comment le tour est réalisé.

Une étude de 2021 publiée dans le Strategic Management Journal a révélé que les retours générés par une intelligence artificielle améliorent la performance des employés plus que les commentaires des managers humains. Le piège ? Cela ne fonctionne que si les employés pensent qu’un humain l’a écrit. Une fois la méthode révélée, la magie disparaît.

Le feedback était plus cohérent, plus personnalisé et objectivement plus efficace pour améliorer la performance, mais une fois que les travailleurs ont appris que des algorithmes généraient les informations sur leur performance, les gains se sont évaporés.

Le même feedback qui améliorait les résultats lorsqu'il était attribué à un manager humain a déclenché de la résistance, moins d’engagement et de moins bons résultats lorsque les employés connaissaient sa véritable origine. Les chercheurs ont appelé cela « l’effet de divulgation », une baisse de performance mesurable causée uniquement par le fait de savoir que l’IA était impliquée.

L’IA dans la gestion de la performance est aujourd’hui de plus en plus répandue, tout comme l’intégration de l’IA dans d’autres domaines de la vie, étant donné la popularité croissante des outils d’IA tels que ChatGPT, Claude et Gemini. Mais le simple fait que l’utilisation ait augmenté ne signifie pas que la confiance ait suivi la même trajectoire.

Pour les responsables RH qui naviguent dans l’adoption de l’IA, le paradoxe révélé par ces chercheurs en 2021 crée une impasse. Déployer des systèmes de feedback IA en toute transparence revient à sacrifier les gains de performance. Cacher l’implication de l’IA expose à des violations catastrophiques de la confiance lorsque la vérité finit par éclater.

Ce choix met en lumière une question fondamentale sur ce que les organisations cherchent à optimiser. Est-ce les résultats du trimestre ou la capacité de transformation à long terme ?

Contexte de la crise de confiance

L’effet de divulgation ne se produit pas dans le vide. Des recherches récentes de SHL montrent que seulement 27 % des employés font entièrement confiance à leur employeur pour utiliser l’IA de manière responsable dans les décisions RH. Plus préoccupant encore, 59 % pensent que l’IA aggrave les biais au travail, au lieu de les réduire.

Cela rend le paradoxe encore plus flagrant. La technologie qui pourrait fournir des retours meilleurs et moins biaisés est en réalité déconfiée par la majorité des employés qui devraient en bénéficier. Et les recherches suggèrent que leur méfiance devient une prophétie auto-réalisatrice. Savoir que l’IA est impliquée les pousse à moins bien performer, même si les retours eux-mêmes sont objectivement supérieurs.

Le Dr Ryne Sherman, Chief Science Officer chez Hogan Assessments, qui travaille avec plus de 75 % des entreprises du Fortune 500, voit deux raisons principales de la résistance des salariés.

La première est l’hypothèse selon laquelle l’IA ne peut pas apprécier les nuances du lieu de travail. Nous supposons qu’un évaluateur humain de la performance a une meilleure perception du contexte organisationnel, et une plus grande appréciation des performances qui ne sont pas nécessairement visibles dans les choses facilement quantifiables par un ordinateur.

Le second facteur va plus loin. Il ne s’agit pas de savoir si l’IA peut évaluer la performance avec précision, mais de ce que le choix d’utiliser l’IA dit sur la façon dont l’organisation considère ses collaborateurs.

« L’absence d’intervention humaine donne aux employés l’impression d’être simplement traités comme de simples ressources humaines, sans empathie ni considération pour leur bien-être en tant qu’êtres humains », explique Sherman. « Nos recherches montrent que les leaders les plus efficaces manifestent une préoccupation authentique pour leurs employés. Utiliser l’IA pour mener les évaluations de performance donne le sentiment que la direction ne se soucie pas réellement de ses employés. »

Que ces hypothèses soient justes ou non importe moins que le fait qu’elles existent. La perception des employés influence leur comportement, et le comportement a un impact direct sur la performance.

Pourquoi la dissimulation ne fonctionne pas

Les organisations espérant profiter des bénéfices de la performance de l’IA tout en évitant l’effet de divulgation font face à un problème pratique : les employés savent déjà.

Edie Goldberg, psychologue du travail et des organisations et auteure du prochain livre Performance Enablement, souligne les signes révélateurs qui trahissent les retours générés par l’IA.

La plupart des employés peuvent reconnaître si un retour a été rédigé par un ordinateur, notamment à cause de tous ces tirets. Ce type de retour manque souvent de la spécificité qu’un manager pourrait apporter.

Les schémas stylistiques des textes générés par l’IA sont désormais suffisamment reconnaissables pour que tenter de cacher son implication soit voué à l’échec. Même quand les organisations ne déclarent pas explicitement l’utilisation de l’IA, les employés en repèrent les traces algorithmiques.

Cela sape toute la stratégie de dissimulation. Si les employés soupçonnent la participation de l’IA sans en être informés, les organisations subissent le pire des deux mondes : la baisse de performance liée à la perception d’une intervention de l’IA, conjuguée à la rupture de confiance provoquée par la tentative de tromperie.

L’approche recommandée par Goldberg contourne complètement ce paradoxe.

La distinction est importante. L’IA peut intégrer des retours issus de plusieurs perspectives — collègues, clients, plateformes de communication interne — et les combiner à des données factuelles provenant des systèmes internes.

« Tous ces facteurs rendent le retour naturellement plus équitable, car il ne reflète pas uniquement le point de vue d'une seule personne », explique Goldberg, faisant référence aux nombreuses études sur les biais des managers dans les évaluations de performance.

Mais cet avantage en matière d’équité ne se concrétise que si les employés font confiance au processus. Pour Goldberg, il s'agit d’un problème de répartition des tâches, non de transparence. Utilisez l’IA pour l’agrégation et la détection de schémas, domaines dans lesquels elle excelle. Laissez les humains apporter le contexte, la spécificité et la dimension relationnelle, afin que les employés soient convaincus que les retours sont authentiques.

En fin de compte, la solution n’est pas de cacher le rôle de l’IA, mais de le redéfinir.

L’approche Transparence Avant Tout

Kate O’Neil, PDG de la plateforme de gestion de la performance Opre, a entièrement conçu son produit pour rejeter l’idée de masquer l’IA. Tous les retours reçus par les utilisateurs d’Opre sont clairement identifiés comme générés par l’IA, et ni managers ni employés ne peuvent les modifier pour les faire passer pour des productions humaines.

Il ne devrait jamais y avoir de confusion sur ce qui est généré par l’IA ou par un humain. Après tout, comment garder ‘l’humain dans la boucle’ si personne ne sait ce qui, dans la boucle, est généré par l’humain ou par l’IA ? Le manque de clarté sur l’origine des retours ne fait que brouiller la responsabilité managériale.

La philosophie de conception d’Opre tourne autour de ce qu’O’Neil appelle une dynamique « manager-et-employé contre Opre ». Le système envoie des informations de performance aux deux parties en même temps, créant ainsi un référentiel commun pour la discussion plutôt qu’un jugement descendant.

Lors de leur prochain point individuel, manager et employé discutent de ce qu’Opre a bien compris, de ce qu’il a manqué et de ce qu’il pourrait interpréter de façon erronée dans le contexte.

« Cela remplace une dynamique bien moins productive souvent observée aujourd’hui : manager contre employé, surtout lorsque la performance est faible ou que les entretiens d’évaluation sont évités », explique O’Neil.

Mais O’Neil reconnaît qu’elle ne dispose pas de données comparatives. « Je ne sais pas si le fait que les employés savent que c’est généré par l’IA a eu un impact, car je n’ai pas de population d’employés qui ignorent que c’est généré par l’IA pour faire la comparaison. »

Interrogée sur la possibilité de perdre des gains de performance en privilégiant la transparence, O’Neil ne tergiverse pas.

Je ne pense pas que le fait de savoir que c’est généré par l’IA diminue l’efficacité. Je pense que l’illusion d’un retour authentique quand ce n’est pas le cas détruit la confiance et le contrat social entre managers et équipes. Une confiance rompue nuit à la performance.

Elle va plus loin sur la question du biais. Même si les retours générés par l'IA réduisent objectivement les biais à court terme, dissimuler leur origine crée un problème de confiance qui, à terme, accroît finalement les biais.

« Si le contenu généré par l’IA réduit effectivement les biais, mais que les employés ont l'impression qu'il les augmente, alors l’impact à long terme sera une dégradation de la confiance », explique O'Neil. « Les managers qui font passer les retours générés par l’IA pour les leurs dégradent la confiance entre eux et leurs équipes, ce qui mène par la suite à une augmentation des biais. »

C’est pourquoi le système d’Opre empêche les managers de modifier ou d’adoucir les analyses produites par l’IA. Le manager et l’employé reçoivent des retours identiques au même moment, éliminant toute possibilité de tromperie. Managers et employés peuvent ajouter du contexte ou demander des clarifications au système, mais ils ne peuvent pas modifier ce que celui-ci produit.

Sa position repose aussi sur une réflexion concernant les horizons temporels. Les organisations peuvent optimiser leurs indicateurs de performance immédiate ou leur capacité à se transformer sur plusieurs années. Selon elle, ces deux objectifs sont incompatibles en matière de déploiement de l’IA.

« L’opacité n’est pas une stratégie de performance », affirme-t-elle. « C’est une stratégie d’extraction à court terme. Vous pouvez obtenir une poussée d’efforts le temps que les employés tentent de comprendre les règles. Mais peu après, vous perdez vos meilleurs éléments, vous épuisez les autres, et vous nuisez à votre attractivité auprès de nouveaux talents. »

Quand la confiance se brise

Goldberg et Sherman avertissent tous deux que la tromperie autour de l’utilisation de l’IA entraîne des conséquences bien plus lourdes que tout gain de performance à court terme.

« Il est facile de briser la confiance, et très difficile de la reconstruire », explique Goldberg. « Il n’y a ici aucun avantage, seulement du risque. »

Cet avertissement n’est pas qu’une posture éthique. Goldberg et Sherman travaillent tous deux dans des milieux où ils constatent les conséquences de la perte de confiance dans de nombreuses organisations. Leur certitude que la tromperie échoue découle de l’observation de schémas, pas seulement de la philosophie.

« C’est désastreux pour une organisation d’adopter des pratiques trompeuses lors des évaluations de performance », prévient Sherman. « D’abord, dans toute organisation de taille significative, il n’y a strictement aucun espoir que la tromperie ne soit pas dévoilée. Toutes les organisations connaissent des fuites d’informations, et ce genre d’information finira absolument par sortir.

Les conséquences, selon Sherman, seraient sévères.

« Lorsque cette information sera connue, la confiance dans l’organisation atteindra un niveau absolument catastrophique », dit-il. « Le personnel protestera, démissionnera, et pire encore, se désengagera totalement. »

Son remède pour les organisations prises dans un tel scénario est sans appel. Les employés exigeront des comptes, ce qui signifie probablement l’éviction des dirigeants impliqués dans la tromperie.

« Même alors », poursuit-il, « l’organisation devra sérieusement envisager de transformer entièrement son processus d’évaluation de la performance vers une transparence radicale pour commencer à regagner la confiance. »

Le conseil de Goldberg aux organisations qui se retrouvent dans cette situation est plus simple mais en arrive à la même conclusion.

Ce que révèle le choix

La décision de révéler ou non le recours à l’IA dans la gestion de la performance n’est que rarement présentée comme un choix entre performance et confiance. Le plus souvent, il s’agit d’une question technique de mise en œuvre ou d’un problème de gestion du changement. Or les recherches suggèrent qu’il s’agit en réalité d’un test décisif des valeurs d’une organisation.

Les entreprises optimisant leurs indicateurs de performance à court terme ont tout intérêt à dissimuler l’intervention de l’IA. L’effet du déploiement est réel et mesurable.

Celles qui souhaitent transformer leur organisation à long terme ne peuvent se permettre une violation de la confiance, même au prix d’une performance immédiate plus faible.

Il existe aussi un aspect de classe préoccupant que les praticiens évoquent rarement. Dans les organisations qui ne communiquent que partiellement sur l’usage de l’IA, qui est informé ? Les cadres bénéficient-ils de systèmes transparents alors que les salariés de première ligne reçoivent des retours masqués par l’IA ? Le fossé de confiance entre la direction et les employés est déjà profond. Une divulgation sélective pourrait l’aggraver dramatiquement.

Le point de Sherman sur la découverte inéluctable mérite d’être souligné. À une époque où les employés prennent des captures d’écran des communications internes, postent anonymement sur les sites d’avis d’entreprise et s’organisent via des canaux Slack privés, l’idée que l’intervention de l’IA dans l’évaluation des performances pourrait rester secrète n’est pas crédible.

Ajoutez à cela l’observation de Goldberg : les employés savent déjà reconnaître un texte généré par l’IA grâce à ses schémas. Dès lors, la stratégie de dissimulation ressemble moins à une stratégie qu’à une tentative de gagner du temps.

La question n’est donc pas de savoir si les employés le découvriront, mais ce qui se passera quand ce sera le cas.

AI Transparency in Performance Management

Un autre usage

Goldberg voit la véritable promesse de l’IA dans la gestion de la performance venir d’une toute autre direction : le feedback en temps réel plutôt que des évaluations annuelles ou trimestrielles.

Les systèmes d’IA peuvent aider à fournir beaucoup de feedback à l’instant où il est le plus utile, explique-t-elle. Mais l’IA peut intégrer tous ces points de retour d’expérience sur une période de performance pour offrir un portrait plus équilibré et moins biaisé de la performance individuelle. C’est là la puissance de l’IA dans la gestion des performances, pas simplement la rédaction de l’évaluation.

Cela revoit la question de la divulgation. Si l’IA donne un retour immédiat et contextuel sur des actions précises — signale quand les délais d’un projet glissent, note quand les schémas de collaboration changent, souligne quand la fréquence de communication baisse — la source importe moins que la rapidité. Les employés peuvent voir le lien direct entre leurs actions et le feedback, ce qui instaure la confiance dans la précision du système au lieu de la saper.

L’évaluation annuelle de performance rédigée par l’IA déclenche toujours l’effet de divulgation parce qu’on tente de reproduire un jugement humain dans un contexte où la relation et l’autorité jouent un rôle.

Le feedback en temps réel de l’IA fonctionne sur un autre registre. Il n’essaie pas d’imiter la sagesse humaine, il fournit une observation basée sur les données que les humains auraient du mal à répéter à grande échelle.

Reste à savoir si cette approche permet d’éviter la baisse de performance que la divulgation entraîne : cela n’a pas encore été testé à grande échelle, d’après ce que j’ai pu constater, et la perception du phénomène pourrait changer à mesure que la familiarité avec le fonctionnement de l’IA grandit. Mais cela suggère que le débat cacher ou révéler pose peut-être la mauvaise question à propos de la mauvaise application de cette technologie.

La question non résolue

Pour les dirigeants qui réfléchissent aujourd’hui au déploiement de l’IA, la recherche n’offre aucune solution confortable.

Les partisans de la transparence — O’Neil, Goldberg, Sherman — soutiennent que masquer l’implication de l’IA garantit une catastrophe de confiance lorsque c’est découvert, et que les employés savent déjà détecter un texte généré par l’IA. Mieux vaut bâtir dès maintenant une culture d’entreprise adaptée à l’IA par l’honnêteté, même si cela nuit à la performance à court terme.

L’argument opposé est plus difficile à écarter qu’il n’y paraît. Si le feedback de l’IA réduit objectivement les biais, offre des évaluations plus constantes et améliore les résultats, la transparence est-elle un luxe coûteux qui sert d’abord à rassurer les responsables RH sur leur éthique ?

Aucun camp ne peut s’appuyer sur des données longitudinales montrant ce qui se passe au bout de trois ans de feedback d’IA transparent. La technologie a évolué trop vite et les déploiements sont trop récents. Mais ce choix reflète ce que les dirigeants pensent de leurs équipes et ce qu’ils sont prêts à sacrifier pour obtenir des résultats.

Les organisations qui ont opté pour l’opacité ont parié que les gains de performance compenseraient la future crise de confiance. Celles qui choisissent la transparence parient que bâtir une culture adaptée à l’IA nécessite d’être honnête sur son rôle, même si cela coûte à la performance à court terme.

Les recherches montrent ce qui se passe immédiatement après la divulgation. Ce à quoi nous ne pouvons pas encore répondre avec autant de certitude, c’est quelle méthode bâtira sur le long terme des organisations plus résilientes et performantes.

Pour l’instant, cela reste une question de philosophie, de tolérance au risque, et du type d’organisation que les dirigeants souhaitent construire.