Vertrauensprobleme: Amerikaner fürchten den Missbrauch von KI durch Führungskräfte mehr als die KI selbst. Dies verdeutlicht tiefere Vertrauensprobleme.

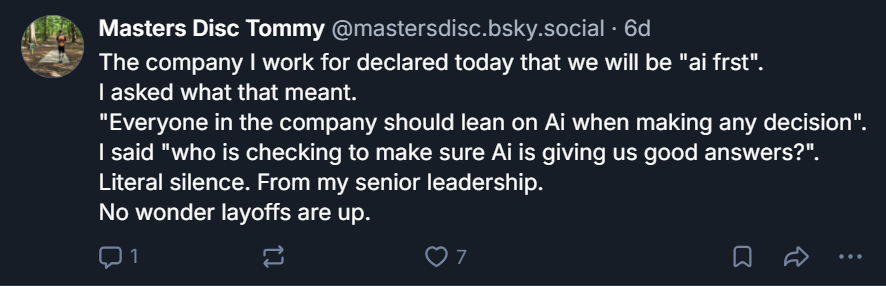

Stimmungen am Arbeitsplatz: Arbeitnehmer beurteilen KI nach dem Verhalten der Führungsetage und vergangenen Machtmissbräuchen, nicht nach technischen Vorteilen.

EU-Vergleich: Europäer teilen die KI-Ängste, profitieren aber von regulatorischen Rahmenbedingungen, die US-Arbeitnehmern fehlen.

Vertrauen in Arbeitgeber: US-Arbeitgeber genießen mehr Vertrauen als andere Institutionen, aber das Vertrauen bleibt fragil und ungleich verteilt.

Strategien für Führungskräfte: Erfolgreiche KI-Einführung erfordert Transparenz und die Einbindung aller Mitarbeiterebenen.

Je mehr ich mit Menschen spreche – unabhängig davon, in welcher Branche sie tätig sind –, desto mehr wird eines deutlich: Die Amerikaner haben keine Angst vor KI oder Technologie im Allgemeinen. Sie haben Angst davor, was die Menschen an der Spitze damit tun werden.

Diese Unterscheidung ist wichtiger als jede Kennzahl oder Produkteinführung, denn sie verändert die gesamte Diskussion über die Einführung von KI am Arbeitsplatz. Die vorherrschende Erzählung betrachtet Widerstand gegen KI als ein Bildungsproblem, das sich durch bessere Schulungen und ein geschmeidigeres Onboarding lösen lässt. Aber die Daten erzählen eine andere Geschichte.

Die Angst, die amerikanische Arbeitnehmer erfasst, hat mit jahrzehntelangen gebrochenen Versprechen der Institutionen zu tun, die sie beschäftigen, regieren und angeblich ihre Interessen vertreten.

Der Edelman Trust Barometer 2025 zählt die Vereinigten Staaten zu den fünf großen Volkswirtschaften mit dem geringsten Vertrauen weltweit, mit einem Trust Index von 47 von 100. Japan, Deutschland, Großbritannien und Frankreich vervollständigen diese Gruppe.

Einundsechzig Prozent der weltweiten Befragten berichten über ein mittleres oder hohes Maß an Unzufriedenheit – definiert als die Überzeugung, dass Regierung und Unternehmen nur eigenwillige Interessen bedienen, während gewöhnliche Menschen zu kämpfen haben. In den USA ist das Bild noch deutlicher: Dreimal so viele Amerikaner lehnen die zunehmende Nutzung von KI ab als sie befürworten, 49 % gegenüber 17 %.

Diese Zahlen beschreiben keine Bevölkerung, die von Technologie verwirrt ist. Sie beschreiben eine Bevölkerung, die seit einer Generation erlebt, wie Unternehmensführungen zu viel versprechen und zu wenig liefern – und KI nun als das nächste Mittel in diesem Kreislauf sehen.

Die Daten zum Arbeitsplatz bestätigen das. Der TrustID Index von Deloitte dokumentierte einen Rückgang des Vertrauens in firmeneigene generative KI um 31 % zwischen Mai und Juli 2025. Das Vertrauen in agentische KI-Systeme, die unabhängig handeln können und nicht nur Empfehlungen abgeben, ist im selben Zeitraum um 89 % eingebrochen.

Arbeitnehmer bewerten die Technologie nicht nach ihren technischen Vorzügen. Sie bewerten sie danach, wer die Kontrolle darüber hat und was diese Personen in der Vergangenheit mit Macht getan haben.

Eine KI-spezifische Schnellumfrage von Edelman, die Ende 2025 in fünf Ländern durchgeführt wurde, zeigte: Mitarbeitende sind 2,5-mal stärker motiviert, KI zu akzeptieren, wenn sie sich sicherer im Job fühlen. Zwei von drei KI-Skeptikern gaben an, dass sich die Einführung erzwungen anfühlt und nicht freiwillig ist. Und auf die Frage, wem sie vertrauen, die Wahrheit über KI zu sagen, entschieden sich Beschäftigte doppelt so häufig für Kolleg:innen wie für CEOs oder Regierung.

Gerade dieses letzte Ergebnis ist die stille Anklage. Beschäftigte wollen nichts von der Führungsebene über KI hören. Sie wollen es von jemandem hören, der neben ihnen sitzt und keinen Vorteil davon hat, die Botschaft zu beschönigen.

Eine andere Art von Angst

Vergleichen Sie das mit Europa. Auch Europäer sind nicht besonders begeistert von KI. Deutschland und Großbritannien liegen beide am unteren Ende des Trust Index. Aber europäische Arbeitnehmer bewegen sich in einem grundsätzlich anderen System. Einige wichtige Unterschiede:

- Der EU AI Act reguliert Hochrisiko-KI-Anwendungen im Arbeitsleben

- Betriebsräte geben Mitarbeitern eine formelle Stimme bei der Einführung neuer Technologien

- Länder wie Deutschland und Frankreich verlangen Beratungen vor Massenentlassungen

- Der Europäische Gewerkschaftsbund drängt auf eine eigene Richtlinie zu algorithmischen Systemen am Arbeitsplatz, einschließlich verpflichtender menschlicher Kontrolle bei KI-gesteuerten Entscheidungen und kollektiver Mitbestimmung bei deren Einsatz.

Die EU arbeitet darüber hinaus an einem sogenannten „KI-Sozialpakt“ – einem Rahmenwerk, das dem Europäischen Sozialfonds angegliedert ist und Beschäftigte während durch KI verursachter Umbrüche mit Einkommenshilfen, Umschulungen und beim Arbeitsplatzwechsel unterstützen soll. Der bestehende Europäische Fonds für die Anpassung an die Globalisierung bietet bereits ein – wenn auch unterfinanziertes – Beispiel dafür, wie Arbeitnehmer in Zeiten des Umbruchs aufgefangen werden können.

Das bedeutet nicht, dass europäische Arbeitnehmer entspannt mit KI umgehen. Doch ihre Sorgen nehmen eine andere Form an: Sie machen sich Gedanken über Überwachung, Datenschutz und die Macht von Unternehmen. Sie lenken ihre Bedenken über regulatorische Rahmen und kollektivvertragliche Strukturen, die ihnen – so unvollkommen diese auch sein mögen – einen Platz am Tisch verschaffen. Wenn ein deutscher Arbeitnehmer hört, dass KI seine Rolle verändern könnte, kann er oder sie vernünftigerweise erwarten, dass zumindest jemand in Regierung oder Gewerkschaft sich mit den möglichen Folgen auseinandergesetzt hat.

Amerikanische Arbeitnehmer können keine derartigen Erwartungen haben. In den USA sind die Konsequenzen strukturell gravierender, weil die Krankenversicherung an die Beschäftigung gekoppelt ist. Einen Arbeitsplatz zu verlieren bedeutet nicht nur, das Einkommen zu verlieren. Es bedeutet, das gesamte soziale Netz zu verlieren.

In den USA ist „at-will employment“ (Kündigung nach Belieben) Standard. Die Gewerkschaftsquote bewegt sich auf historischem Tiefstand. Es gibt keinen bundesweiten Rahmen zur Regulierung von KI am Arbeitsplatz. Hört ein amerikanischer Arbeitnehmer, dass KI seinen Job verändern könnte, ist die berechtigte Frage: Und dann? Wer fängt mich auf?

Die Antwort lautet immer häufiger: niemand. Und die Beschäftigten wissen das.

Der Arbeitgeber als letzte Instanz

Hier wird die Geschichte für Führungskräfte, die diesen Beitrag lesen, kompliziert. Selbst wenn das Vertrauen in Regierung und Medien auf dem Tiefpunkt ist, bleiben Arbeitgeber die vertrauenswürdigste Institution in den USA.

Laut der McKinsey-Mitarbeiterumfrage 2024 vertrauen 71 % der Beschäftigten ihrem eigenen Arbeitgeber, künstliche Intelligenz ethisch einzusetzen – eine höhere Rate als bei Universitäten, großen Tech-Unternehmen oder Start-ups. Die Daten von Edelman zeigen: 66 % der Beschäftigten vertrauen darauf, dass ihr Arbeitgeber das Richtige tut. Dieser Wert blieb alters-, geschlechts-, einkommens- und parteiübergreifend stabil.

Doch dieses Vertrauen ist fragil. Weltweit sank das Arbeitgebervertrauen 2025 um 3 Punkte – der erste spürbare Rückgang seitdem Arbeitgeber an der Spitze stehen (seit 2021). Und das Vertrauen verteilt sich ungleich. Edelman stellte eine 13-Punkte-Lücke zwischen Arbeitenden im unteren und oberen Einkommensquartil fest. 65 % der Amerikaner im untersten Einkommensquartil glauben, von KI abgehängt zu werden. Die Hälfte der Befragten aus der mittleren Einkommensgruppe empfindet das genauso.

Whitney Munro, CEO und Gründerin von FLEX Partners, erlebt das live. Sie sagt:

In den Organisationen, die wir beraten, hängen die Resultate bei der Einführung von KI nahezu perfekt vom bereits bestehenden Vertrauensverhältnis zwischen Führung und Mitarbeitenden ab.

Wo Mitarbeiter während früherer Veränderungsphasen ehrlich kommuniziert wurden, sind sie heute optimistischer und bereit, KI eine Chance zu geben. Wo das Gegenteil stattfand – Entscheidungen im luftleeren Raum, ohne Kommunikation –, wird KI für sie, wie sie es ausdrückt, „zu einem Blitzableiter für Konflikte“.

Dann beginnen die Angestellten zu hinterfragen, ob die Einführung tatsächlich der Produktivität dient oder ob es um das Stellenabbau geht – und sie beginnen, sich entbehrlich zu fühlen.

Die Menschen, die mitten in diesem Spannungsfeld stehen, sind die VPs, Direktoren und Bereichsleiter, die den Wandel nach unten transportieren sollen.

Kelly Meerbott, Führungskräfte-Coach, CEO von You Loud and Clear und TEDx-Rednerin zum Thema psychologische Sicherheit, beschreibt sie als „menschliche Stoßdämpfer“ – zwischen den Prioritäten der Chefetage und der Lebenswirklichkeit der Belegschaft.

Sie sind erschöpft“, sagt sie. „Weil sie die PR-Botschaften der Geschäftsführung in Worte übersetzen müssen, die ihr Team überhaupt glaubt. Und wenn diese mittleren Führungskräfte selbst nicht an die Botschaft glauben, kollabiert die gesamte Vertrauenskette, bevor KI überhaupt die Mitarbeitenden an der Basis erreicht.

Wie eine CHRO oder ein COO in den nächsten zwei Jahren mit dieser Spannung umgeht, entscheidet, ob KI zu einem Vertrauensaufbau wird – oder zum endgültigen Bruch.

Die Edelman-Daten geben einen Hinweis darauf, was funktioniert: Peer-to-Peer-Kommunikation über KI wirkt etwa doppelt so gut wie Top-down-Botschaften. Freiwilligkeit schlägt Zwangseinführung. Und der mit Abstand stärkste Motor für Vertrauen in KI ist die eigene Erfahrung, sprich: das Erleben, dass KI die eigene Arbeit wirklich erleichtert.

Das bedeutet: Es geht künftig weniger um Strategie-Präsentationen, sondern mehr um die konkrete Alltagserfahrung. Glaubt die Person auf dem Lagerboden oder im regionalen Vertriebsbüro, dass das KI-Tool – ob nun für tägliche Aufgaben oder Leistungsbewertung – ihr Leben wirklich besser macht? Oder glaubt sie, es liefert lediglich Argumente, ihre Position in anderthalb Jahren zu streichen?

Die Technologie liefert auf diese Frage keine Antwort. Es ist das Verhältnis zwischen Arbeitnehmenden und Arbeitgeber. Und in einem Land, in dem das institutionelle Vertrauen seit Jahrzehnten schwindet, trägt diese Beziehung Lasten, für die sie nie konzipiert war.

Vertrauen folgt Menschen, nicht Plattformen

Die Forschung erkennt ein Muster, das Führungskräften Orientierung geben sollte: Vertrauen in KI beginnt nicht bei der KI – es folgt einer älteren, zutiefst menschlichen Logik.

Menschen nutzen, was sie gefahrlos erkunden können. Sie erkunden, was jemand, dem sie vertrauen, bereits ausprobiert hat. Und sie verpflichten sich dann, wenn sie selbst erleben, dass das Werkzeug wirklich zur Unterstützung – und nicht zum Ersatz – gedacht ist.

Es lohnt sich, diese Reihenfolge näher zu betrachten, denn sie läuft dem Ansatz der meisten Unternehmen bei Technologie-Einführungen entgegen. Das gängige Muster ist Top-down: Führungskräfte-Ankündigung, Trainings für alle, Nutzungskennzahlen, Leistungsintegration.

Jeder einzelne Schritt verstärkt die Machtasymmetrie, der die Beschäftigten bereits misstrauen. Es vermittelt ihnen das Gefühl, dass KI mit ihnen geschieht – nicht für sie. In einer Situation, in der sich schon zwei Drittel der Skeptiker von KI gezwungen fühlen, verstärkt dieses Muster nicht nur das Problem – es beschleunigt es sogar.

David Kolodny, Mitgründer des Startup-Studios Wilbur Labs, das seit 2016 über 21 Tech-Firmen gebaut und in sie investiert hat, kennt diese Seite aus der Sicht der Anbieter.

Eine feste Überzeugung aus meiner langen Erfahrung mit Automatisierung ist: Die Grundlagen sind heute genauso entscheidend wie eh und je“, sagt er. „Automatisierung erfordert eine sorgfältige Einrichtung, rigorose Qualitätskontrollen und eine aufmerksam begleitete Überwachung im Betrieb.

Der übereilte Einsatz von Technologie ist, anders gesagt, der Ort, an dem Vertrauen stirbt. „Es ist um ein Vielfaches einfacher, Vertrauen zu zerstören als es aufzubauen“, ergänzt Kolodny, „und deshalb gibt es so viele Menschen, die der Technologie gegenüber zurückhaltend sind.“

Munro argumentiert, dass der Wandel grundlegender sein muss als nur das Tempo zu variieren.

Man kann KI nicht einfach als technische Einführung ausrollen“, sagt sie. „Es muss kulturell sein.

Das bedeutet, dass Führungskräfte einige sehr klare Maßnahmen ergreifen müssen:

- Explizit angeben, wofür KI eingesetzt wird und wofür nicht.

- Klarstellen, ob Personalabbau Teil der langfristigen Strategie ist, anstatt die Mitarbeitenden ihre schlimmsten Annahmen ausfüllen zu lassen.

- Teams frühzeitig in Tests einbeziehen, damit sie Teil des Prozesses sind, und offen über die Kompromisse sprechen, anstatt lediglich Produktivitätsgewinne zu feiern, von denen die Beschäftigten vermuten, dass sie auf ihre Kosten gehen.

- Überprüfen Sie Ihre Handlungen daraufhin, ob sie mit Ihren Werten im Hinblick auf Überwachung übereinstimmen. KI für „Erwischt“-Überwachung einzusetzen, wird Mitarbeitende sofort abschrecken und jede bereits bestehende Angst bestätigen.

Was die Vertrauensdaten unter all dem suggerieren, ist fast trügerisch einfach: Mit kleinen Schritten beginnen. Menschen die Möglichkeit geben, sich freiwillig zu beteiligen. Die Beschäftigten finden, die wirklich neugierig sind — nicht diejenigen, die für das Management Begeisterung inszenieren — und ihnen Raum geben, ohne Bewertungsbögen zu experimentieren.

Wenn diese Personen dann zurückkommen und ihren Kolleginnen und Kollegen erzählen, dass ein bestimmtes Tool ihnen zwei Stunden an einem Bericht gespart oder ihnen geholfen hat, ein Muster zu entdecken, das sie sonst übersehen hätten, wiegt dieses Zeugnis schwerer als jede Präsentation – weil es ohne Hintergedanken kommt.

Das Plädoyer für Unsicherheit

Auch Führungskräfte in der Geschäftsleitung müssen bereit sein zu sagen, was sie nicht wissen. Die Edelman-Daten zeigten, dass zwei Drittel der Beschäftigten in Industrieländern glauben, dass Führungskräfte nicht völlig ehrlich über die Auswirkungen von KI auf Arbeitsplätze sein werden. Diese Erwartung von Unehrlichkeit ist bereits eingepreist.

Der einzige Weg, das aufzubrechen, ist radikale Transparenz darüber, was sich durch KI verändern wird, was nicht – und wo das Unternehmen noch keine echte Antwort hat. Meerbott bringt es direkter auf den Punkt.

Sagen Sie anderen Führungskräften, dass Sie verwirrt sind oder keine Antwort haben“, sagt sie. „Schocken Sie sie mit Ihrer Menschlichkeit.

Dieser Rat widerspricht jahrzehntelanger Führungsetikette, aber er deckt sich genau mit dem, was die Vertrauensdaten offenbaren. Die meisten Führungskräfte sind darauf trainiert, Sicherheit zu vermitteln. In diesem Umfeld wirkt Sicherheit wie bloßes Marketing. Unsicherheit zuzugeben – verbunden mit der sichtbaren Bereitschaft, zusammen mit den Mitarbeitenden Lösungen zu finden und nicht über ihren Köpfen hinweg – ist eine glaubwürdigere Haltung als jede ausgefeilte Transformationsgeschichte.

Die amerikanische KI-Angst ist ein kulturelles Artefakt, das Produkt einer Gesellschaft, die die Strukturen, die Menschen in Umbruchphasen Sicherheit geben, systematisch abgebaut hat. Europa hat Leitplanken aufgestellt, bevor das Auto losfuhr. Die USA verlangen von ihren Beschäftigten, dem Fahrer zu vertrauen, während das Auto beschleunigt – obwohl die Erfolgsbilanz des Fahrers bestenfalls durchwachsen ist.

Ich glaube nicht, dass Amerikaner:innen grundsätzlich mehr Angst vor KI haben als andere“, sagt Munro. „Ich glaube nur, wir sind misstrauischer gegenüber Machtstrukturen, die Vertrauen und Gegenseitigkeit nicht konsequent bewiesen haben.

Dieses Misstrauen kommt nicht von ungefähr. Es wurde verdient. Und für CHROs und COOs, die diesen Moment gestalten, ist das die Ausgangslage.

Jede KI-Einführung, jede Automatisierungsentscheidung, jede Umstrukturierung der Belegschaft wird durch ein Vertrauensdefizit gefiltert, das schon lange bestand, bevor jemand einen Prompt in ChatGPT eingab. Das Defizit anzuerkennen ist der erste Schritt. Es zu schließen, ist die Aufgabe des nächsten Jahrzehnts.